ИИ не незаметно проник в нашу жизнь. Он ворвался в нее, сел за стол и начал доканчивать наши предложения.

Вместо полезного списка ссылок Google теперь пытается ответить на ваш вопрос. Copilot от Microsoft составляет черновики ответов вашему начальнику ещё до того, как вы успели выпить кофе. Ваш телефон подводит итоги разговоров, о которых вы даже не помните.

Все крупные технологические компании стремятся внедрить искусственный интеллект в свои продукты, поскольку никто не хочет отставать. А общественность часто вынуждена мириться с такими корпоративными прихотями из-за усиливающегося явления «эншитификации», как объяснил Кори Доктороу в подкасте «Lock and Code».

Люди используют ИИ. Но они ему не доверяют.

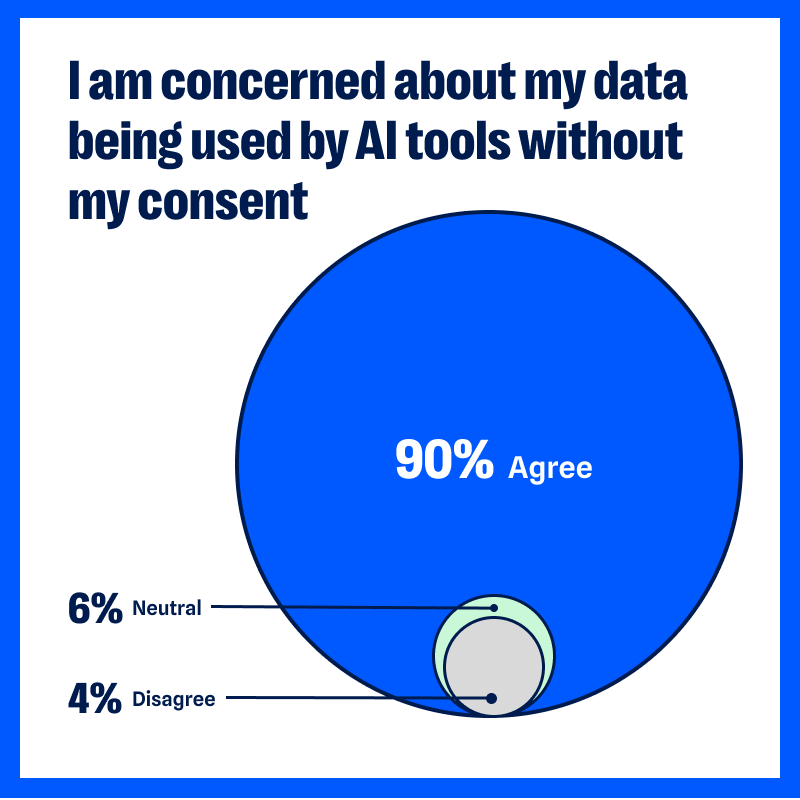

В нашем последнем опросе «Privacy Pulse», в ходе которого в начале этого года мы собрали 1 200 ответов от подписчиков Malwarebytes , 90 % респондентов заявили, что их беспокоит использование их данных искусственным интеллектом без их согласия.

Девяносто процентов.

Это не просто несколько скептиков. Это почти все, кого мы опросили. Признаем, наша выборка, вероятно, состоит преимущественно из тех, кто заботится о конфиденциальности. Но 90 % подписчиков Malwarebytes тем, сколько личных данных поглощает ИИ и что он с ними делает, так что это хороший показатель того, насколько всем следует об этом беспокоиться.

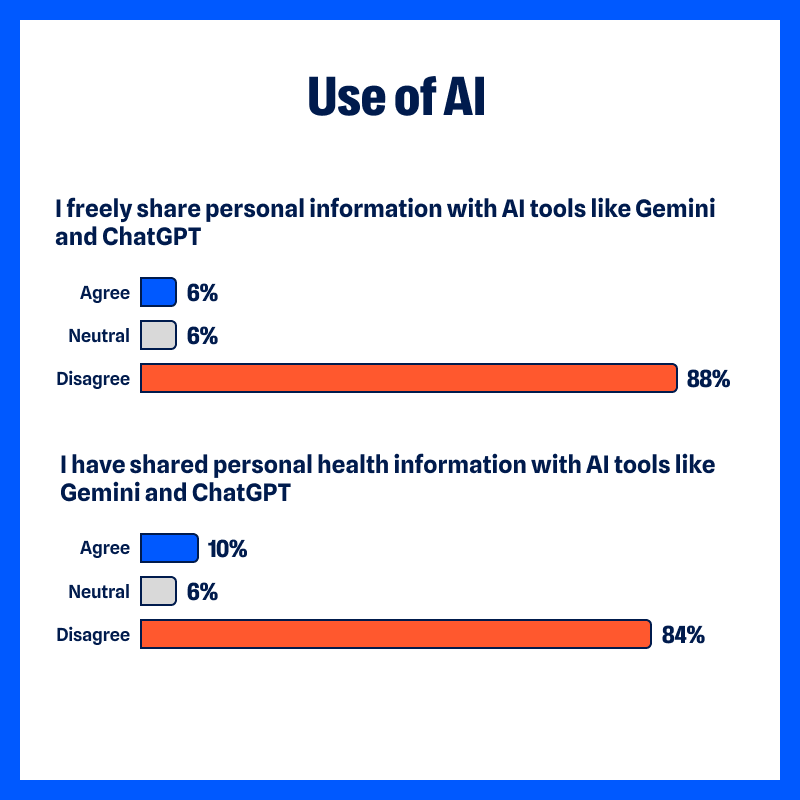

Эта обеспокоенность меняет то, как люди пользуются Интернетом:

- 88 % респондентов не «добровольно предоставляют личную информацию инструментам искусственного интеллекта, таким как ChatGPT и Gemini»

- 84 % респондентов не «делились личной медицинской информацией с инструментами искусственного интеллекта»

- 43 % «перестали пользоваться ChatGPT»

- 42 % «перестали пользоваться Gemini»

Это недоверие возникло не с появлением ИИ

Конечно, искусственный интеллект занимает все заголовки. Мы пишем о многих из них.

Однако люди уже давно обеспокоены вопросом сохранности своих личных данных.

Из опроса:

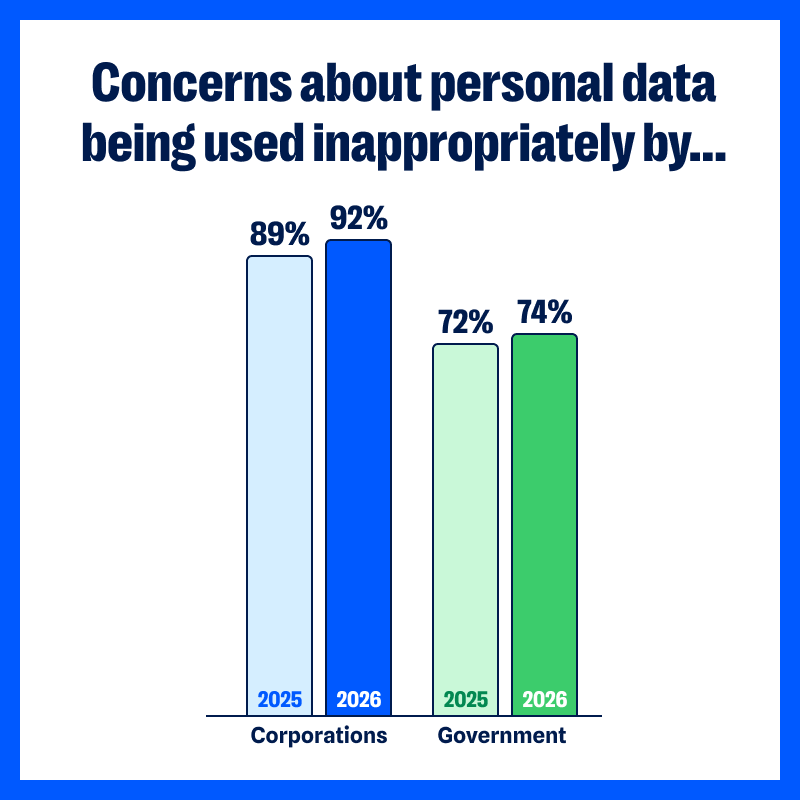

- 92 % опрошенных обеспокоены тем, что «их персональные данные могут быть использованы компаниями ненадлежащим образом», что представляет собой небольшой рост по сравнению с прошлым годом (89 % в 2025 году)

- 74 % опрошенных обеспокоены тем, что «правительство может получить доступ к их личным данным и использовать их ненадлежащим образом» (по сравнению с 72 % ранее)

Многолетние утечки данных, сомнительные методы отслеживания и опасное злоупотребление со стороны брокеров данных постепенно подорвали наше доверие к способности организаций защищать наши данные. В течение последнего года медицинские организации продолжали сообщать о серьезных упущениях в области безопасности, затрагивающих конфиденциальные данные пациентов. Федеральная торговая комиссия (FTC) предупредила о «потрясающих» практиках коммерческого слежения, на которые большинство потребителей никогда не давали согласия, и, согласно нашему опросу, 49% людей сообщили, что их личная информация использовалась в мошеннических схемах, направленных против них или их семей.

Действительно ли искусственный интеллект чем-то отличается, скажем, от социальных сетей?

Когда люди пользуются социальными сетями, они, как правило, понимают, что их клики и лайки отслеживаются. Когда они делают покупки в Интернете, они ожидают, что магазин будет хранить историю их покупок или отслеживать товары, которые их заинтересовали. Они понимают суть рекламы и видят, как она вписывается в социальные или коммерческие сайты.

Инструменты искусственного интеллекта отличаются друг от друга, потому что мы используем их по-разному.

Когда мы делимся с ИИ-помощником своими идеями, записями о встречах с клиентами, личными проблемами и вопросами о здоровье, мы относимся к нему как к доверенному лицу. Возможно, мы оплатили уровень доступа, который гарантирует, что модели не будут обучаться на наших данных. Даже когда мы обсуждаем с ИИ-чатботом на сайте мебель из плоских упаковок и пропавшие винты, мы ведем себя так, будто разговариваем с другим человеком, а не транслируем этот разговор на весь мир.

Взаимодействие с ИИ кажется близким и непринужденным, хотя мы все понимаем, что общаемся с ботом. Именно это делает неопределенность в отношении того, как ИИ обрабатывает предоставленные им данные, более личной и острой.

Мы знаем, что ИИ-помощники от различных компаний часто интегрируются с другими инструментами. Мы знаем, что модели GPT может создать любой разработчик или мошенник. (Поищите Malwarebytes ChatGPT— мы из числа «хороших парней»). Мы знаем, что практически каждая бизнес-платформа или личный сервис сегодня содержит какой-либо элемент сбора данных на основе ИИ. То, чего обычный человек не знает об ИИ, вызывает страх.

- Где хранятся наши подсказки?

- Эти подсказки используются для обучения ИИ?

- Как долго их хранят?

- Кто-нибудь из сотрудников компании может их прочитать?

- Их можно купить? Использовать в рекламных целях? Они просочились в сеть?…

Да, компании публикуют свои политики, но кто в реальном, насыщенном делами мире читает их все перед тем, как воспользоваться сервисом? Менее половины, но их число растет: 48 % респондентов заявили, что теперь читают политики конфиденциальности и отчеты — по сравнению с 43 % в 2025 году.

Кроме того, из недавних новостей известно, что компании спешат выпустить функции искусственного интеллекта, не успев должным образом проверить их на безопасность.

Лучик надежды: люди начинают действовать

Этот результат опроса привлек наше внимание.

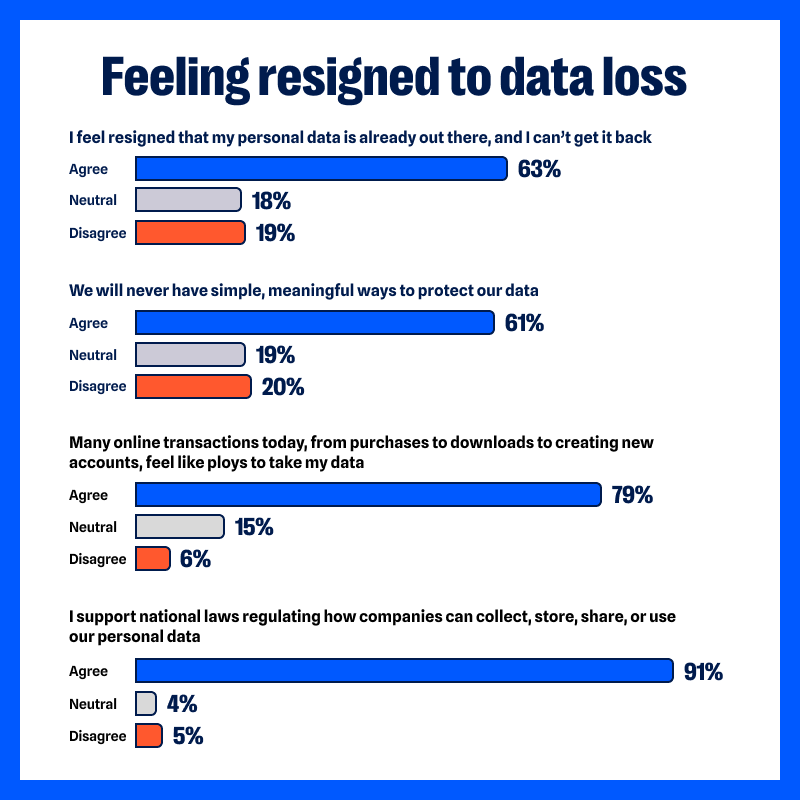

63 % респондентов согласились с утверждением: «Я смирился с тем, что мои личные данные уже попали в открытый доступ, и я не могу их вернуть».

В прошлом году этот показатель составлял 74 %.

Таким образом, хотя обеспокоенность по поводу неправомерного использования данных по-прежнему остается высокой, все меньше людей чувствуют себя совершенно беспомощными.

Респонденты сообщили, что принимают практические меры для ограничения доступа к своим данным.

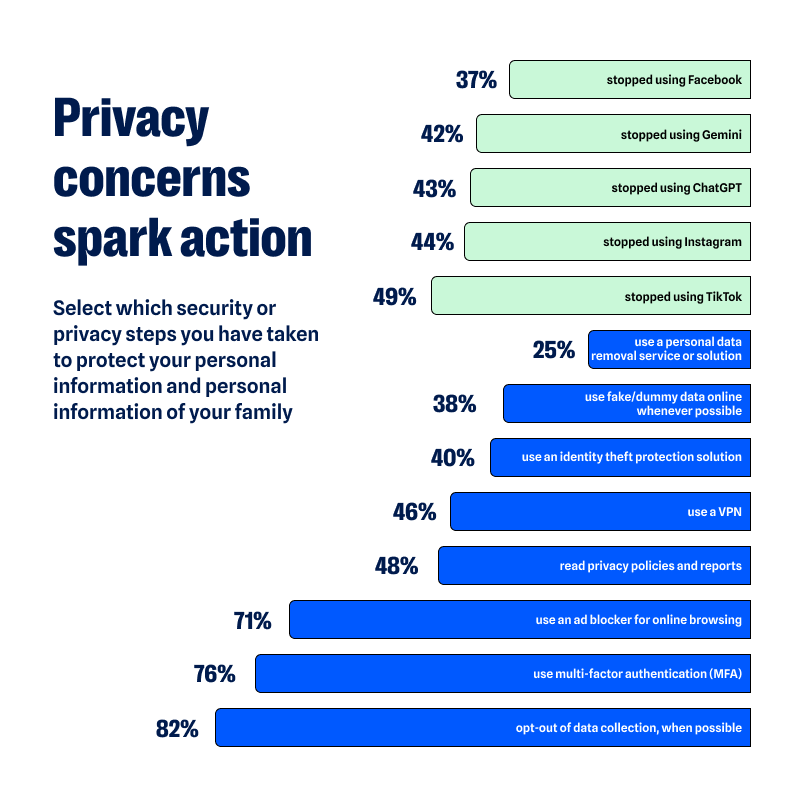

Некоторые пользователи сократили или полностью отказались от использования определенных платформ из-за опасений по поводу конфиденциальности, в том числе социальных сетей (44 % перестали пользоваться Instagram, 37 % — Facebook, а 49 % — TikTok) и инструментов искусственного интеллекта (43 % перестали пользоваться ChatGPT, 42 % — Gemini).

Другие респонденты сообщили, что делятся в Интернете меньшим объёмом личной информации или избегают деликатных тем в онлайн-беседах (88 % заявили, что не делятся личной информацией с инструментами искусственного интеллекта без оглядки).

Кроме того, все чаще используются средства защиты конфиденциальности данных, устройств и личных данных.

- 46 % используют VPN по сравнению с 42 % в 2025 году)

- 40 % используют средства защиты от кражи личных данных (по сравнению с 43 %)

- 25 % пользуются услугами или решениями по удалению персональных данных (по сравнению с 23 %)

- 71 % пользователей используют блокировщики рекламы при работе в Интернете (по сравнению с 69 %)

- 48 % читают политику конфиденциальности и отчеты (по сравнению с 43 %)

- 76 % используют многофакторную аутентификацию (по сравнению с 69 %)

- 82 % пользователей отказываются от сбора данных, если это возможно (по сравнению с 75 %)

- 38 % пользователей по возможности используют в Интернете поддельные или фиктивные данные (по сравнению с 33 %)

Ни одно из этих действий не удаляет историю действий, но они ограничивают риск новых угроз. Дэвид Руис, старший специалист по вопросам конфиденциальности в Malwarebytes, сказал:

«Двадцать лет инноваций в сфере интернета привели слишком много компаний к одному и тому же — к противостоянию с простыми людьми».

Для большинства людей сегодня компании, которые навязывают им инструменты искусственного интеллекта в повседневной жизни, — это те же самые компании, которые нажились на их внимании, посягали на их частную жизнь и допустили утечку их данных. Но появляется противодействующая сила.

«Небольшие изменения в поведении пользователей должны помочь другим понять, что даже сегодня конфиденциальность по-прежнему возможна и имеет смысл».

Privacy может казаться чем-то дихотомическим: либо все находится в открытом доступе, либо все надежно защищено. Однако на самом деле это постепенный процесс, и ответы респондентов отражают то, как люди начинают вновь обретать контроль над своими данными.

Что это означает для компаний

Организации, внедряющие ИИ в свои продукты, сталкиваются с более сложной аудиторией, чем они могли предположить изначально.

На протяжении многих лет команды разработчиков полагали, что пользователи готовы пожертвовать большим объёмом данных ради дополнительного удобства. Однако когда почти девять из десяти человек заявили, что их беспокоит использование их данных искусственным интеллектом без их согласия, доверие стало неотъемлемой частью самого продукта. Компания Mozilla оперативно отреагировала на эту ситуацию и добавила в Firefox простую кнопку«Отключить ИИ».

Уже недостаточно просто рассказывать о том, на что способен ИИ. Пользователи хотят понимать, что происходит после того, как они нажмут кнопку «Отправить».

Мы, народ… хотим строгих законов о защите частной жизни

Когда уровень обеспокоенности достигает таких масштабов, как показал наш опрос, это неизбежно поднимает сложный вопрос о регулировании.

91 % респондентов заявили, что «поддерживают национальные законы, регулирующие порядок сбора, хранения, передачи или использования наших персональных данных компаниями».

Дело не столько в конкретном инструменте, сколько в ощущении, что ограничения и рамки использования неясны. Системы генеративного ИИ способны быстро составлять юридические документы, писать электронные письма и обрабатывать конфиденциальные данные. Большая часть существующих правовых рамок в области защиты конфиденциальности в США, ЕС и других регионах была разработана до того, как ИИ стал повсеместным явлением.

Регулирующие органы пытаются не отставать от событий. Закон Европейского союза об искусственном интеллекте, принятый в 2024 году, ввёл подход, основанный на оценке рисков, к регулированию определённых систем искусственного интеллекта. В США федеральные агентства, в том числе Федеральная торговая комиссия (FTC), выпустили рекомендации и предупреждения, касающиеся коммерческого наблюдения и автоматизированного принятия решений, однако в стране пока отсутствует всеобъемлющий закон о конфиденциальности, специально предназначенный для сферы искусственного интеллекта.

Стремление к принятию национальных законов и нормативных актов достигло беспрецедентного уровня. Потребители хотят, чтобы правила были понятными и поддавались исполнению.

Что вы можете сделать

Мы, конечно же, не собираемся отказываться от всех технологий. ИИ не уничтожит сам себя. Он может быть весьма полезен. Мы используем ИИ для выявления угроз и мошеннических схем, с которыми раньше никто не сталкивался, что позволяет обеспечить гораздо более надежную защиту. Мы также используем генеративный ИИ в Scam Guard для круглосуточной поддержки в чате (конечно же, в сочетании с нашим глубоким опытом в области исследования угроз). Многие люди используют его, чтобы сэкономить время, составлять черновики документов или генерировать идеи. А также, к сожалению, для создания небольших карикатур на себя.

Главное здесь — разумное использование.

- Ограничьте объем информации, которую вы предоставляете общедоступным инструментам искусственного интеллекта, особенно сведения о здоровье, финансовые данные и конфиденциальную информацию о клиентах.

- Ознакомьтесь с политикой конфиденциальности и правилами хранения данных тех инструментов искусственного интеллекта, которыми вы регулярно пользуетесь.

- Удалите аккаунты и приложения, которые вам больше не нужны.

- Проверяйте разрешения приложений не реже двух раз в год.

- Используйте VPN ограничить отслеживание со стороны вашего интернет-провайдера.

- Удалите свои данные с крупнейших сайтов брокеров данных. Проверьте, не попала ли ваша личная информация в открытый доступ, с помощью сканирования «цифрового следа».

- Используйте надежный менеджер паролей и не используйте одни и те же пароли для разных сервисов.

В Malwarebytes мы считаем, что право на неприкосновенность частной жизни является одним из прав человека. Защита персональных данных неотделима от обеспечения личной безопасности. Чем больше информации циркулирует без надзора, тем выше риск злоупотреблений, мошенничества и причинения вреда.

Искусственный интеллект будет развиваться и дальше. Вряд ли этот процесс замедлится. Вопрос в том, будет ли вместе с ним расти и доверие к нему.

Информация об опросе

С 26 января по 3 февраля 2026 года Malwarebytes экспресс-опрос среди подписчиков своей рассылки с помощью платформы Alchemer Survey.

Всего в опросе приняли участие 1 235 человек из 72 стран, причем большинство респондентов проживают в США, Великобритании, Канаде и Австралии.