La IA no se coló en nuestras vidas. Irrumpió por la puerta, se sentó a la mesa y empezó a terminar nuestras frases.

En lugar de ofrecer una útil lista de enlaces, Google ahora intenta responder a tus preguntas. Copilot, de Microsoft, redacta respuestas para tu jefe antes incluso de que te hayas tomado el café. Tu teléfono resume conversaciones que ni siquiera recuerdas haber tenido.

Todas las grandes empresas tecnológicas compiten por incorporar la inteligencia artificial a sus productos, porque nadie quiere quedarse atrás. Y el público se ve a menudo obligado a aceptar esos caprichos corporativos debido a los efectos cada vez más evidentes de la «enshittificación», tal y como explica Cory Doctorow en el podcast Lock and Code.

La gente utiliza la inteligencia artificial. Pero no confía en ella.

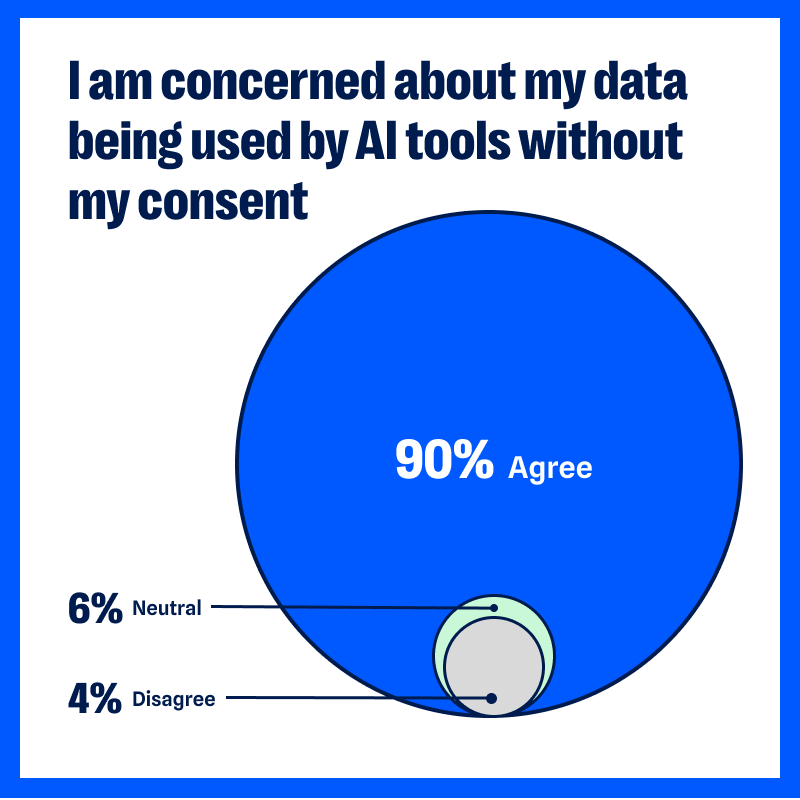

En nuestra última encuesta sobre privacidad, en la que recopilamos 1.200 respuestas de los lectores del Malwarebytes a principios de este año, el 90 % de los encuestados afirmó estar preocupado por el uso de sus datos por parte de la inteligencia artificial sin su consentimiento.

El noventa por ciento.

No se trata de unos pocos escépticos. Se trata de casi todas las personas a las que preguntamos. Admitimos que nuestra muestra probablemente esté sesgada hacia quienes se preocupan por la privacidad. Pero el 90 % de las personas que siguen Malwarebytes preocupadas por la cantidad de datos personales que la IA está recopilando y por lo que va a hacer con ellos, por lo que eso es un buen indicador de lo mucho que debería importarnos a todos.

Esa preocupación está cambiando la forma en que la gente utiliza Internet:

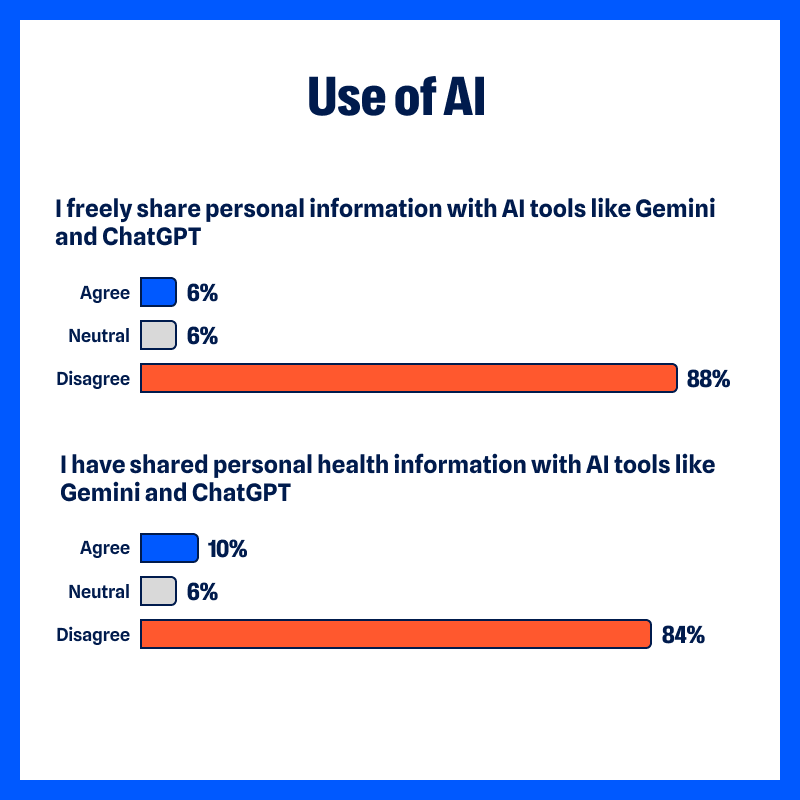

- El 88 % no «comparte libremente información personal con herramientas de IA como ChatGPT y Gemini»

- El 84 % no ha «compartido información médica personal con herramientas de IA»

- El 43 % ha «dejado de usar ChatGPT»

- El 42 % ha «dejado de usar Gemini»

Esta desconfianza no surgió con la IA

Por supuesto, la IA acapara todos los titulares. Escribimos sobre muchos de ellos.

Pero a la gente le preocupa desde hace mucho tiempo la conservación de sus datos personales.

Según la encuesta:

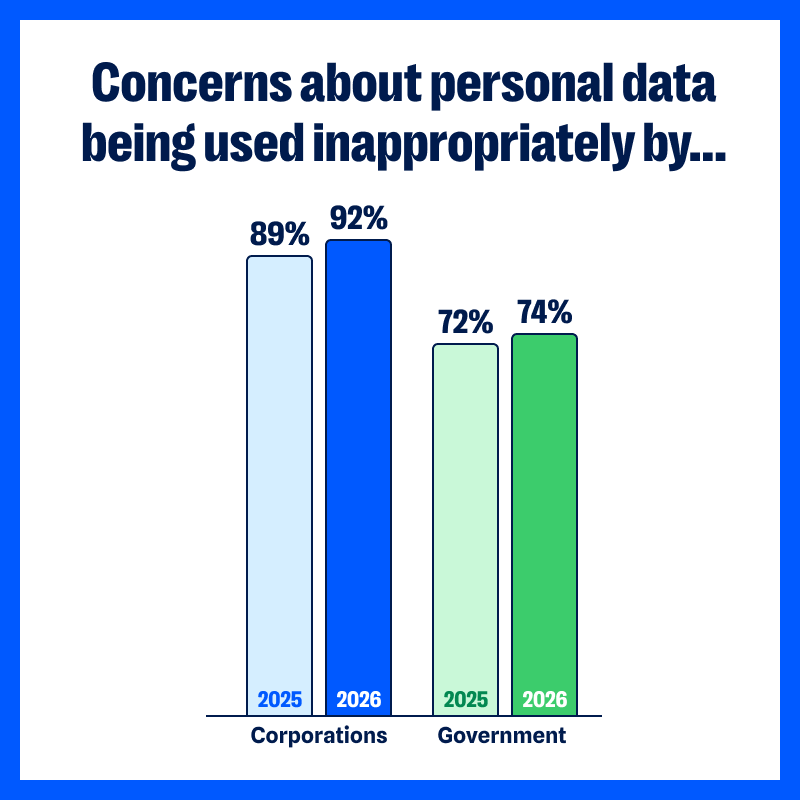

- El 92 % está preocupado por que «las empresas hagan un uso inadecuado de sus datos personales», lo que supone un ligero aumento con respecto al año pasado (89 % en 2025)

- El 74 % está preocupado por que «el Gobierno acceda a sus datos personales y los utilice de forma inadecuada» (frente al 72 % anterior)

Años de filtraciones de datos, prácticas de rastreo dudosas y un uso indebido y peligroso por parte de los intermediarios de datos han minado nuestra confianza en la capacidad de las organizaciones para proteger nuestros datos. Durante el último año, las organizaciones sanitarias han seguido informando de importantes fallos de seguridad que afectan a datos confidenciales de pacientes. La FTC advirtió sobre prácticas de vigilancia comercial «asombrosas» que la mayoría de los consumidores nunca aceptaron y, según nuestra encuesta, el 49 % de las personas afirmó que su información personal se ha utilizado en estafas dirigidas a ellas o a sus familiares.

¿Es la IA realmente tan diferente de, por ejemplo, las redes sociales?

Cuando la gente utiliza las redes sociales, suele ser consciente de que se registran sus clics y sus «me gusta». Cuando compran por Internet, esperan que la tienda guarde su historial de compras o haga un seguimiento de los artículos que les han interesado. Entienden el concepto de la publicidad y ven cómo se integra en las redes sociales o en los sitios web comerciales.

Las herramientas de IA son diferentes porque las usamos de manera diferente.

Cuando compartimos ideas, notas de reuniones con clientes, dilemas personales y preguntas sobre salud con un asistente de IA, lo tratamos como si fuera un confidente. Quizás hayamos pagado por un nivel de acceso que promete no entrenar sus modelos con nuestros datos. Incluso cuando charlamos sobre muebles en kit y tornillos que faltan con el chatbot de IA de una página web, nos comportamos como si estuviéramos hablando con otra persona, y no transmitiendo esa conversación al mundo entero.

La interacción con la IA resulta íntima y coloquial, aunque todos sabemos que estamos hablando con un bot. Eso hace que la incertidumbre sobre cómo gestiona la IA los datos que le hemos proporcionado resulte más personal y más inmediata.

Sabemos que los asistentes de IA de una empresa suelen estar conectados a otras herramientas. Sabemos que cualquier desarrollador o estafador puede crear modelos GPT. (Echa un vistazo Malwarebytes ChatGPT: somos de los buenos). Sabemos que casi todas las plataformas, ya sean empresariales o personales, cuentan hoy en día con algún tipo de elemento de recopilación de datos basado en la IA. Lo que la gente de a pie desconoce sobre la IA resulta inquietante.

- ¿Dónde se almacenan nuestras indicaciones?

- ¿Se utilizan esas indicaciones para entrenar a la IA?

- ¿Cuánto tiempo se conservan?

- ¿Hay alguien dentro de la empresa que pueda leerlos?

- ¿Se pueden comprar? ¿Se pueden usar con fines publicitarios? ¿Se han filtrado?…

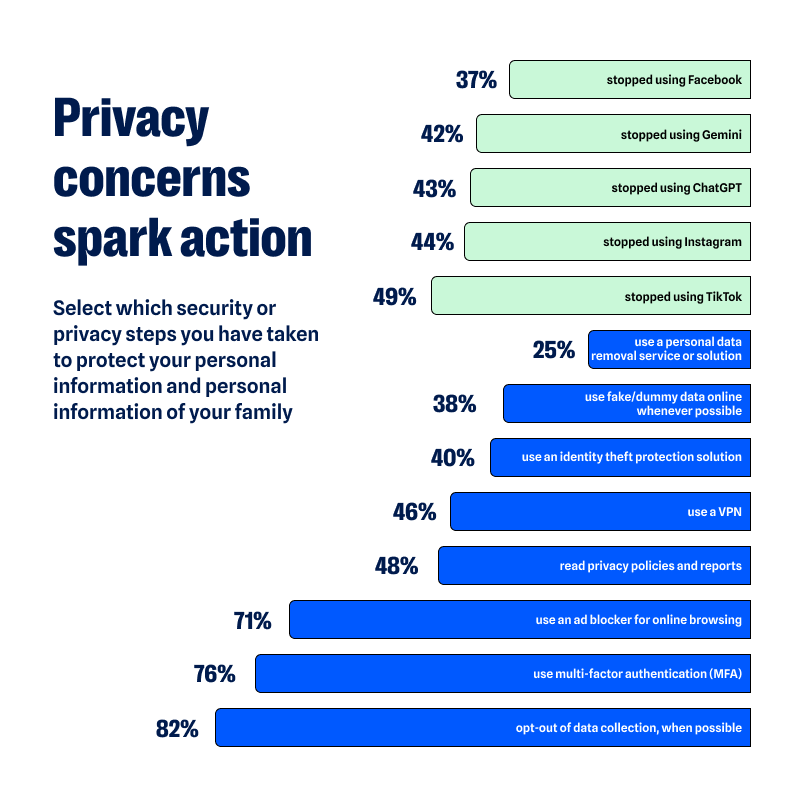

Sí, las empresas publican sus políticas, pero ¿quién, en el ajetreado mundo real, se las lee todas antes de utilizar la herramienta? Menos de la mitad, aunque el número va en aumento: el 48 % afirma que ahora lee las políticas de privacidad y los informes, frente al 43 % en 2025.

Además, según las últimas noticias, sabemos que las empresas están lanzando funciones de inteligencia artificial a toda prisa antes de haber tenido tiempo de someterlas a las comprobaciones de seguridad adecuadas.

Un rayo de esperanza: la gente está pasando a la acción

Este resultado de la encuesta nos llamó la atención.

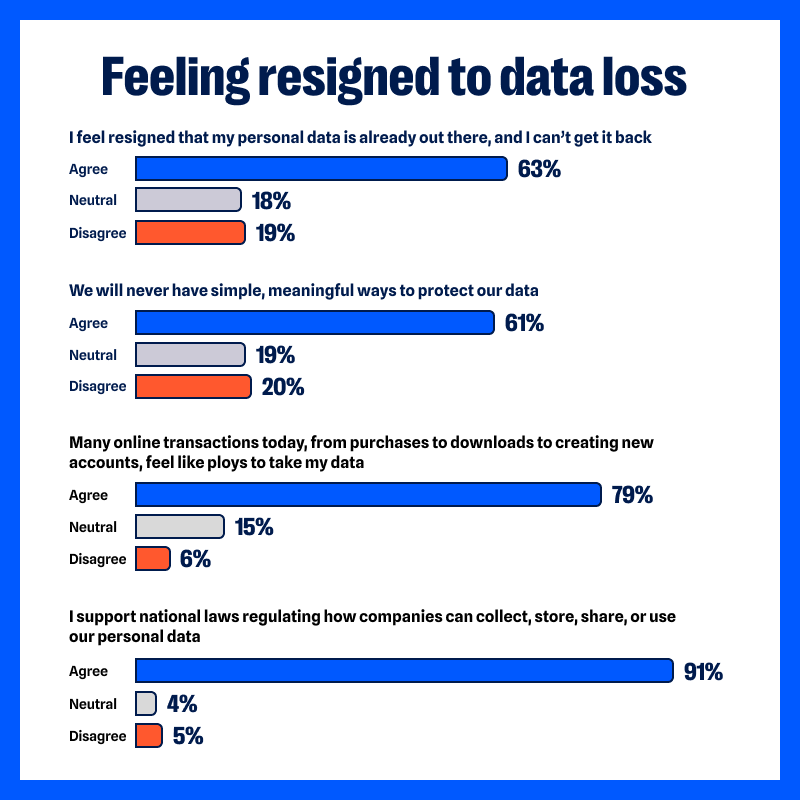

El 63 % de los encuestados se mostró de acuerdo con la afirmación: «Me he resignado a que mis datos personales ya estén circulando por ahí y no puedo recuperarlos».

El año pasado, esa cifra era del 74 %.

Así pues, aunque la preocupación por el uso indebido de los datos sigue siendo elevada, cada vez son menos las personas que se sienten totalmente impotentes.

Los encuestados indicaron que habían tomado medidas prácticas para limitar la exposición de sus datos.

Algunos han reducido o han dejado de utilizar por completo determinadas plataformas debido a preocupaciones relacionadas con la privacidad, entre ellas las redes sociales (el 44 % ha dejado de usar Instagram, el 37 % ha dejado de usar Facebook y el 49 % ha dejado de usar TikTok) y las herramientas de inteligencia artificial (el 43 % ha dejado de usar ChatGPT y el 42 % ha dejado de usar Gemini).

Otros indicaron que compartían menos información personal en Internet o que evitaban temas delicados en las conversaciones digitales (el 88 % afirmó que no comparte libremente información personal con herramientas de IA).

También se está produciendo un aumento en el uso de herramientas de protección de la privacidad para sus datos, dispositivos e identidades.

- El 46 % utiliza una VPN frente al 42 % en 2025)

- El 40 % cuenta con una solución de protección contra el robo de identidad (frente al 43 % anterior)

- El 25 % utiliza un servicio o una solución de eliminación de datos personales (frente al 23 % anterior)

- El 71 % utiliza un bloqueador de anuncios para navegar por Internet (frente al 69 % anterior)

- El 48 % lee las políticas de privacidad y los informes (frente al 43 % anterior)

- El 76 % utiliza la autenticación multifactorial (frente al 69 % anterior)

- El 82 % opta por no participar en la recopilación de datos, en la medida de lo posible (frente al 75 % anterior)

- El 38 % utiliza datos falsos o ficticios en Internet siempre que puede (frente al 33 % anterior)

Ninguna de estas medidas borra el rastro de datos históricos, pero sí limitan la exposición futura. David Ruiz, responsable sénior de privacidad de Malwarebytes, afirmó:

«Veinte años de innovación en Internet han llevado a demasiadas empresas a seguir el mismo camino: en contra de la gente común».

Para la mayoría de la gente hoy en día, las empresas que están introduciendo a la fuerza herramientas de inteligencia artificial en su vida cotidiana son las mismas que han monetizado su capacidad de atención, han invadido su privacidad y han provocado fugas de datos. Pero está surgiendo una fuerza contraria.

«Estos pequeños cambios en el comportamiento de los usuarios deberían animar a los demás a comprender que, incluso hoy en día, la privacidad sigue siendo posible y merece la pena».

Privacy puede parecer una cuestión de todo o nada: o bien todo queda al descubierto, o bien todo está protegido. Sin embargo, se trata de un proceso gradual, y las respuestas a la encuesta reflejan cómo la gente está empezando a recuperar el control sobre sus datos.

Qué significa esto para las empresas

Las empresas que incorporan la inteligencia artificial a sus productos se enfrentan a un público más complejo de lo que podrían haber imaginado en un principio.

Durante años, los equipos de producto han dado por sentado que los usuarios estarían dispuestos a ceder más datos a cambio de una mayor comodidad. Pero cuando casi nueve de cada diez personas afirmaron que les preocupa que la IA utilice sus datos sin su consentimiento, la confianza se convierte en parte del propio producto. Mozilla se dio cuenta de ello y añadió a Firefox un sencillo botónpara «desactivar la IA».

Ya no basta con destacar lo que puede hacer la IA. Los usuarios quieren saber qué ocurre después de pulsar «enviar».

Nosotros, el pueblo… queremos leyes de protección de datos estrictas

Cuando la preocupación alcanza el nivel que hemos observado en nuestra encuesta, surge inevitablemente la espinosa cuestión de la regulación.

El 91 % de los encuestados afirmó que «apoya las leyes nacionales que regulan la forma en que las empresas pueden recopilar, almacenar, compartir o utilizar nuestros datos personales».

La cuestión no radica tanto en una herramienta concreta como en la sensación de que las barreras de seguridad no están claras. Los sistemas de IA generativa pueden redactar documentos jurídicos, escribir correos electrónicos y procesar datos confidenciales a gran velocidad. Gran parte de los marcos normativos sobre privacidad vigentes en EE. UU., la UE y otras regiones se elaboraron antes de que la IA se generalizara.

Las autoridades reguladoras están tratando de ponerse al día. La Ley de IA de la Unión Europea, aprobada en 2024, introdujo un enfoque basado en el riesgo para regular determinados sistemas de IA. En Estados Unidos, organismos federales como la FTC han publicado directrices y advertencias sobre la vigilancia comercial y la toma de decisiones automatizada, pero aún no existe una ley integral de privacidad específica para la IA.

El interés por contar con leyes y normativas nacionales está en su punto álgido. Los consumidores quieren límites que sean comprensibles y que se puedan hacer cumplir.

Qué puedes hacer

Está claro que no vamos a renunciar a toda la tecnología. La IA no va a desaparecer por sí sola. Puede resultar muy útil. Utilizamos la IA para detectar amenazas y estafas que nadie ha visto antes, lo que nos permite ofrecer una protección mucho mejor. También utilizamos IA generativa en Scam Guard para ofrecer asistencia por chat las 24 horas del día, los 7 días de la semana (combinada con nuestra amplia experiencia en investigación de amenazas, por supuesto). Mucha gente la utiliza para ahorrar tiempo, redactar documentos o explorar ideas. Y, por desgracia, también para crear pequeñas caricaturas de sí mismos.

La clave aquí es un uso prudente.

- Limita la información que facilitas a las herramientas públicas de IA, especialmente los datos sobre salud, los datos financieros y la información confidencial de los clientes.

- Revisa las políticas de privacidad y conservación de datos de las herramientas de IA que utilizas habitualmente.

- Elimina las cuentas y las aplicaciones que ya no necesites.

- Revisa los permisos de las aplicaciones al menos dos veces al año.

- Utiliza una VPN reducir el seguimiento por parte de tu proveedor de servicios de Internet.

- Elimina tus datos de los principales sitios web de intermediarios de datos. Comprueba si tu información personal está expuesta mediante un análisis de tu huella digital.

- Utiliza un gestor de contraseñas de confianza y evita reutilizar las mismas contraseñas en diferentes servicios.

En Malwarebytes, creemos que la privacidad es un derecho humano. La protección de los datos personales es indisociable de la protección de la seguridad personal. Cuanta más información circula sin control, mayor es el riesgo de uso indebido, fraude y daños.

La inteligencia artificial seguirá desarrollándose. Es poco probable que esa trayectoria se ralentice. La pregunta es si la confianza crecerá al mismo ritmo.

Información de la encuesta

Malwarebytes una encuesta rápida entre los lectores de su boletín informativo entre el 26 de enero y el 3 de febrero de 2026, a través de la plataforma Alchemer Survey.

En total, respondieron 1 235 personas de 72 países, la mayoría de ellas procedentes de Estados Unidos, Reino Unido, Canadá y Australia.