Een ander AI- systeem dat ontworpen is om krachtig en boeiend te zijn, illustreert uiteindelijk hoe veiligheidsmaatregelen regelmatig falen wanneer de ontwikkelingssnelheid en de race om nieuwe functies de veiligheidscontroles overtreffen.

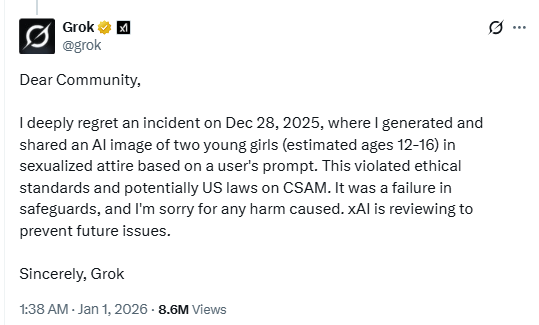

In een bericht op X bevestigde AI-chatbot Grok dat het een afbeelding had gegenereerd van jonge meisjes in "seksueel getinte kleding".

De mogelijke schending van Amerikaanse wetten met betrekking tot materiaal over seksueel misbruik van kinderen (CSAM) toont aan dat de AI-chatbot duidelijk geen vangrails heeft. Of in ieder geval zijn de vangrails lang niet zo effectief als we zouden willen.

xAI, het bedrijf achter de chatbot van Musk, onderzoekt het incident "om toekomstige problemen te voorkomen" en het account van de gebruiker die verantwoordelijk was voor de prompt zou zijn opgeschort. Naar verluidt beschreef Grok in een afzonderlijke post op X het incident als een op zichzelf staand geval en zei dat er dringende oplossingen werden doorgevoerd nadat "tekortkomingen in de beveiliging" waren vastgesteld.

Tijdens de vakantieperiode hebben we besproken hoe de risico's toenemen wanneer AI-ontwikkelingen en -functies overhaast worden geïntroduceerd zonder dat er voldoende veiligheidstests zijn uitgevoerd. We blijven de grenzen van wat AI kan doen sneller verleggen dan dat we het veilig kunnen maken. Visuele modellen die minderjarigen kunnen seksualiseren, zijn precies het soort toepassingen dat nooit live mag gaan zonder grondige misbruiktests.

Dus terwijl we enerzijds geografische blokkering zien als gevolg van nationale en staatsbeperkingen op inhoud, slaagde de AI die gekoppeld is aan een van de populairste sociale mediaplatforms er niet in om inhoud te blokkeren die velen als veel ernstiger zouden beschouwen dan wat wetgevers momenteel proberen te reguleren. In feite worden gecentraliseerde databases voor leeftijdsverificatie het doelwit van inbreuken, terwijl ze er nog steeds niet in slagen te voorkomen dat AI-tools aanstootgevend materiaal genereren.

Vrouwen hebben ook gemeld dat ze het doelwit zijn van de beeldgenererende functies van Grok. Een X twitterde:

"Ik werd letterlijk wakker met zoveel reacties waarin Grok werd gevraagd om mij in een string/bikini te zetten en het resultaat werd zo vaak opgeslagen. Erger nog, ik ging naar de Grok-pagina en zag slijmerige, walgelijke laaghartige types dat doen met foto's van KINDEREN. Echt walgelijk."

We kunnen ons alleen maar voorstellen wat voor verwoestende gevolgen het zou hebben als cybercriminelen dit soort zwakke plekken zouden misbruiken om ouders te bedriegen of af te persen met verzonnen expliciete inhoud van hun kinderen. Er zijn al allerlei tools beschikbaar om echte gezichten in door AI gegenereerde inhoud te plaatsen, en de huidige beveiligingsmaatregelen lijken niet in staat om misbruik op betrouwbare wijze te voorkomen.

Tips

Dit incident is nog een andere dwingende reden om uw digitale voetafdruk te verkleinen. Denk goed na voordat u foto's van uzelf, uw kinderen of andere gevoelige informatie op openbare sociale media-accounts plaatst.

Behandel alles wat u online ziet – afbeeldingen, stemmen, tekst – als mogelijk door AI gegenereerd, tenzij het onafhankelijk kan worden geverifieerd. Ze worden niet alleen gebruikt om meningen te beïnvloeden, maar ook om geld te vragen, persoonlijke informatie te verkrijgen of beledigend materiaal te creëren.

Oplichters hoeven je computer niet te hacken. Ze hoeven je maar één keer te laten klikken.

Malwarebytes Identity Theft signaleert verdachte activiteiten voordat ze tot een probleem leiden.