Los investigadores han descubierto un método para robar datos que elude los mecanismos de seguridad integrados en Microsoft Copilot.

El flujo del ataque, denominado Reprompt, aprovecha la forma en que Microsoft Copilot gestiona los parámetros URL para secuestrar la sesión personal de Copilot existente de un usuario.

Copilot es un asistente de inteligencia artificial que se conecta a una cuenta personal y está integrado en Windows, el Edge y diversas aplicaciones de consumo.

El problema se solucionó en la actualización Patch Tuesday de enero de Microsoft y, hasta ahora, no hay pruebas de que se haya explotado en la práctica. Aun así, esto demuestra una vez más lo arriesgado que puede ser confiar en los asistentes de IA en este momento.

Reprompt oculta una solicitud maliciosa en el parámetro q de una URL de Copilot que, por lo demás, es legítima. Cuando se carga la página, Copilot ejecuta automáticamente esa solicitud, lo que permite al atacante realizar acciones en la sesión autenticada de la víctima con solo un clic en un enlace de phishing.

En otras palabras, los atacantes pueden ocultar instrucciones secretas dentro de la dirección web de un enlace de Copilot, en un lugar donde la mayoría de los usuarios nunca miran. Copilot ejecuta entonces esas instrucciones ocultas como si los usuarios las hubieran escrito ellos mismos.

Dado que Copilot acepta indicaciones a través de un parámetro URL q y las ejecuta automáticamente, un correo electrónico de phishing puede engañar al usuario para que haga clic en un enlace de Copilot que parece legítimo, mientras se introducen silenciosamente instrucciones controladas por el atacante en una sesión activa de Copilot.

Lo que distingue a Reprompt de otros ataques similares de inyección de comandos es que no requiere comandos introducidos por el usuario, ni plugins instalados, ni conectores habilitados.

La base del ataque Reprompt es sorprendentemente simple. Aunque Copilot aplica medidas de seguridad para evitar fugas directas de datos, estas protecciones solo se aplican a la solicitud inicial. Los atacantes pudieron eludir estas barreras de seguridad simplemente indicando a Copilot que repitiera cada acción dos veces.

Partiendo de ahí, los investigadores señalaron:

«Una vez ejecutada la primera orden, el servidor del atacante emite instrucciones de seguimiento basadas en respuestas anteriores y forma una cadena continua de solicitudes. Este enfoque oculta la verdadera intención tanto al usuario como a las herramientas de supervisión del lado del cliente, lo que dificulta enormemente su detección».

Cómo mantenerse seguro

Puede protegerse específicamente contra el ataque Reprompt instalando las actualizaciones del Patch Tuesday de enero de 2026.

Si está disponible, utilice Microsoft 365 Copilot para los datos de trabajo, ya que se beneficia de la auditoría de Purview, la prevención de pérdida de datos (DLP) a nivel de inquilino y las restricciones de administración que no estaban disponibles para Copilot Personal en el caso de investigación. Las reglas DLP buscan datos confidenciales, como números de tarjetas de crédito, números de identificación y datos médicos, y pueden bloquear, advertir o registrar cuando alguien intenta enviarlos o almacenarlos de forma arriesgada (correo electrónico, OneDrive, Teams, conectores de Power Platform y más).

No hagas clic en enlaces no solicitados antes de verificar con la fuente (de confianza) si son seguros.

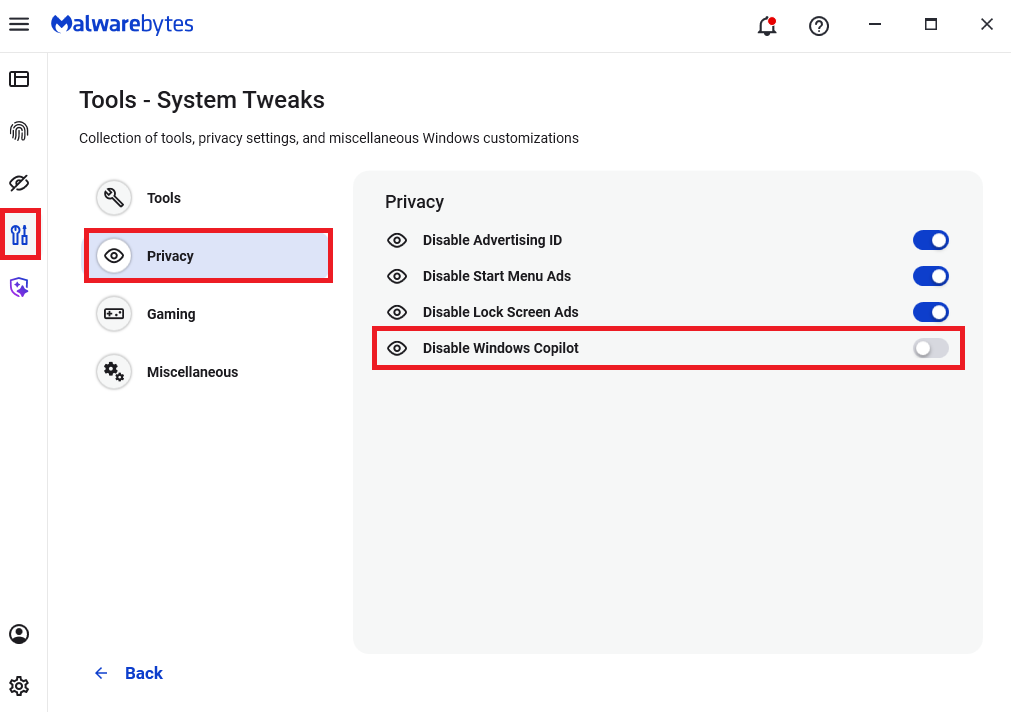

Según se informa, Microsoft está probando una nueva política que permite a los administradores de TI desinstalar el asistente digital Copilot, basado en inteligencia artificial, en los dispositivos gestionados.

Malwarebytes Los usuarios pueden desactivar Copilot en sus equipos personales en Herramientas > Privacy, donde pueden activar (azul) la opción Desactivar Windows .

En general, hay que tener en cuenta que el uso de asistentes de IA sigue planteando riesgos para la privacidad. Mientras exista la posibilidad de que los asistentes recopilen automáticamente información no fiable —como parámetros de URL, texto de páginas, metadatos y comentarios— y la incorporen a indicaciones o instrucciones ocultas del sistema sin una separación o filtrado rigurosos, los usuarios seguirán corriendo el riesgo de que se filtre su información privada.

Por lo tanto, al utilizar cualquier asistente de IA que pueda controlarse mediante enlaces, automatización del navegador o contenido externo, es razonable suponer que los problemas del tipo «Reprompt» son, como mínimo, posibles y deben tenerse en cuenta.

No nos limitamos a informar de las amenazas: las eliminamos

Los riesgos de ciberseguridad nunca deben propagarse más allá de un titular. Mantenga las amenazas alejadas de sus dispositivos descargando Malwarebytes hoy mismo.