A IA não entrou sorrateiramente em nossas vidas. Ela irrompeu pela porta, sentou-se à mesa e começou a completar nossas frases.

Em vez de uma lista útil de links, o Google agora tenta responder à sua pergunta. O Copilot da Microsoft redige respostas para o seu chefe antes mesmo de você tomar o café. Seu celular resume conversas das quais você nem se lembra de ter tido.

Todas as grandes empresas de tecnologia estão correndo para incorporar IA aos seus produtos, pois ninguém quer ficar para trás. E o público muitas vezes é forçado a aceitar esses caprichos corporativos devido aos efeitos crescentes da “enshittification”, conforme explicado por Cory Doctorow no podcast Lock and Code.

As pessoas estão usando a IA. Mas não confiam nela.

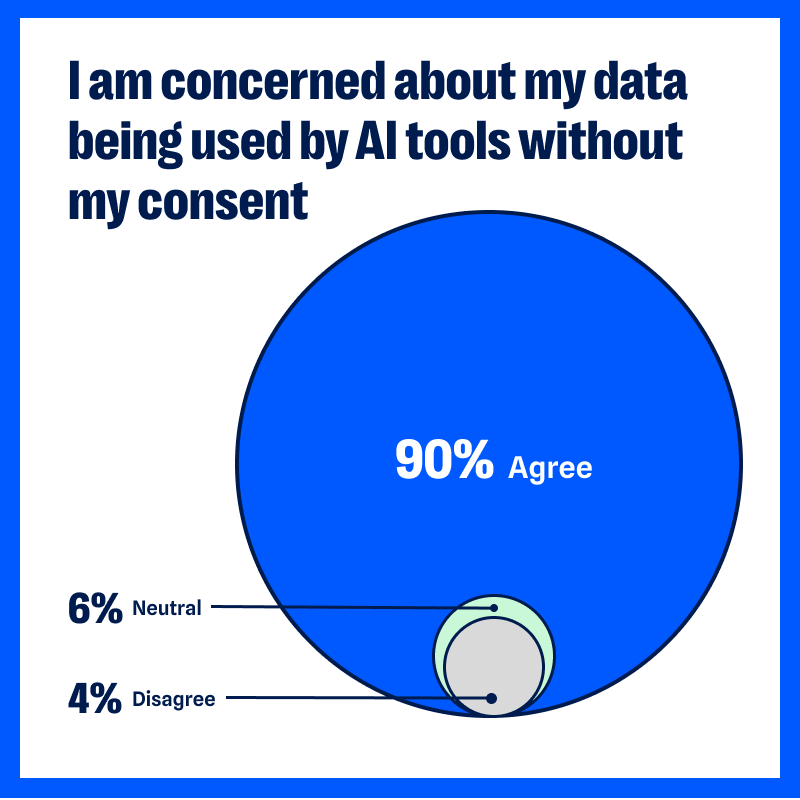

Em nossa mais recente pesquisa sobre privacidade, na qual coletamos 1.200 respostas de leitores do Malwarebytes no início deste ano, 90% dos entrevistados afirmaram estar preocupados com a possibilidade de a IA utilizar seus dados sem consentimento.

Noventa por cento.

Não se trata de alguns céticos. Trata-se de quase todas as pessoas a quem perguntamos. Admitimos que nossa amostra provavelmente está inclinada para aqueles que se preocupam com a privacidade. Mas 90% das pessoas que seguem Malwarebytes preocupadas com a quantidade de dados pessoais que a IA está coletando e com o que ela fará com eles; portanto, isso é um bom indicador do quanto todos deveriam se preocupar.

Essa preocupação está mudando a forma como as pessoas usam a internet:

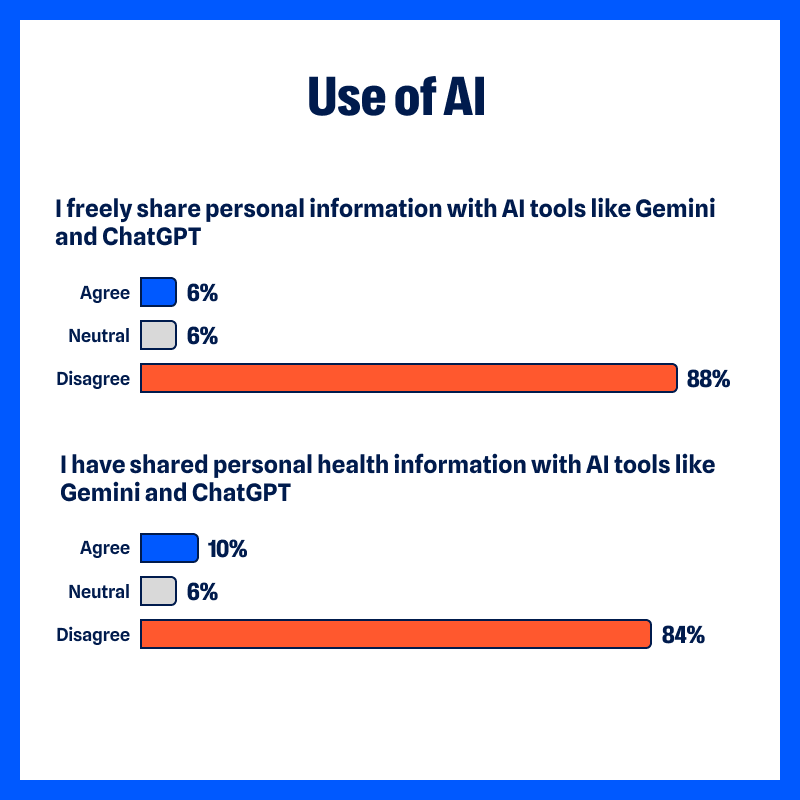

- 88% não “compartilham livremente informações pessoais com ferramentas de IA como o ChatGPT e o Gemini”

- 84% não “compartilharam informações pessoais de saúde com ferramentas de IA”

- 43% “deixaram de usar o ChatGPT”

- 42% “deixaram de usar o Gemini”

Essa desconfiança não começou com a IA

É claro que a IA é o assunto que mais aparece nas manchetes. Escrevemos sobre muitos desses assuntos.

Mas há muito tempo que as pessoas se preocupam com a proteção de suas informações pessoais.

Segundo a pesquisa:

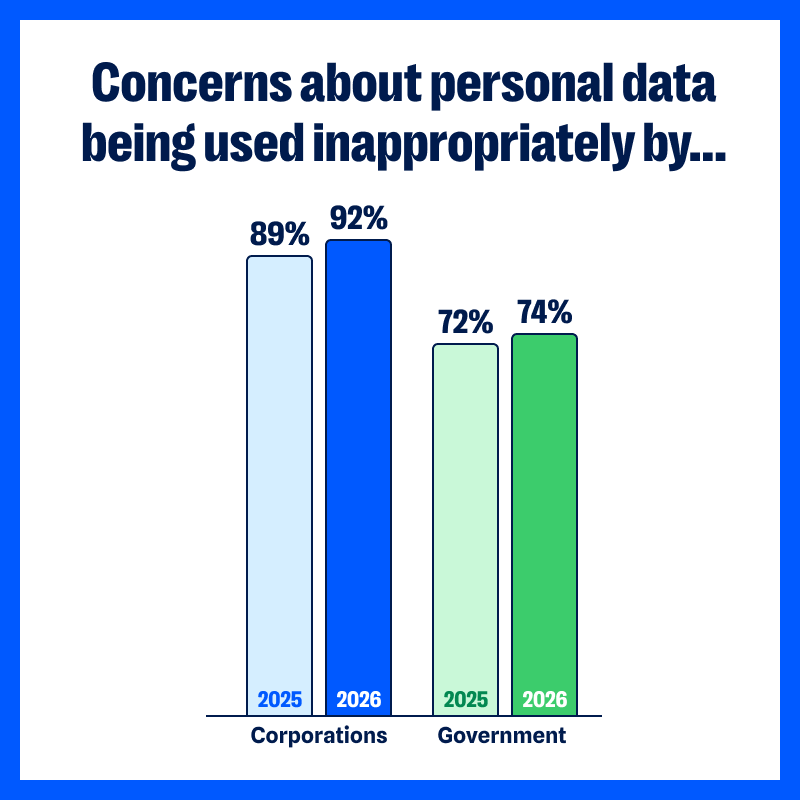

- 92% estão preocupados com o fato de seus “dados pessoais serem utilizados de forma inadequada pelas empresas”, o que representa um ligeiro aumento em relação ao ano passado (89% em 2025)

- 74% estão preocupados com a possibilidade de seus “dados pessoais serem acessados e utilizados de forma inadequada pelo governo” (um aumento em relação aos 72% anteriores)

Anos de violações de dados, práticas de rastreamento duvidosas e uso indevido perigoso por parte de corretores de dados minaram nossa confiança na capacidade das organizações de proteger nossos dados. Ao longo do último ano, as organizações de saúde continuaram a relatar falhas graves de segurança que afetaram dados confidenciais de pacientes. A FTC alertou sobre práticas de vigilância comercial “chocantes” com as quais a maioria dos consumidores nunca concordou e, de acordo com nossa pesquisa, 49% das pessoas relataram que suas informações pessoais foram usadas em golpes direcionados a elas ou a suas famílias.

A IA é realmente diferente, digamos, das redes sociais?

Quando as pessoas usam as redes sociais, geralmente sabem que seus cliques e curtidas estão sendo rastreados. Quando fazem compras online, esperam que a loja armazene seu histórico de compras ou acompanhe os itens nos quais demonstraram interesse. Elas compreendem o conceito de publicidade e percebem como ela se encaixa em sites sociais ou comerciais.

As ferramentas de IA são diferentes porque as usamos de maneira diferente.

Quando compartilhamos ideias, anotações de reuniões com clientes, dilemas pessoais e dúvidas sobre saúde com um assistente de IA, estamos tratando-o como um confidente. Talvez tenhamos pago por um nível de acesso que promete não treinar seus modelos com nossos dados. Mesmo quando conversamos sobre móveis em kit e parafusos faltantes com o chatbot de IA de um site, agimos como se estivéssemos falando com outra pessoa, e não divulgando essa conversa para o mundo.

A interação com a IA parece íntima e coloquial, embora todos saibamos que estamos conversando com um bot. Isso torna a incerteza sobre como essa IA lida com os dados que lhe fornecemos mais pessoal, mais imediata.

Sabemos que os assistentes de IA de uma empresa costumam estar integrados a outras ferramentas. Sabemos que os GPTs podem ser criados por qualquer desenvolvedor ou golpista. (Dê uma olhada Malwarebytes ChatGPT— nós somos do time dos mocinhos). Sabemos que quase todas as plataformas, sejam elas empresariais ou pessoais, contam hoje com algum tipo de elemento de coleta de dados baseado em IA. O que a pessoa comum não sabe sobre IA pode parecer assustador.

- Onde são armazenadas nossas sugestões?

- Essas instruções são usadas para treinar a IA?

- Por quanto tempo são mantidos?

- Alguém dentro da empresa pode lê-los?

- É possível comprá-los? Usá-los para fins publicitários? Vazaram?…

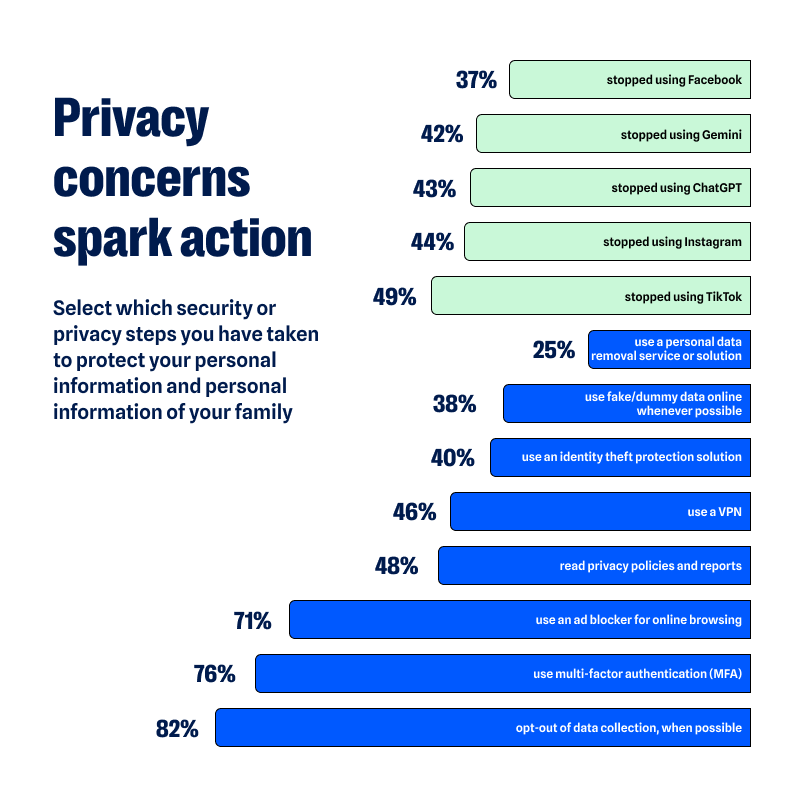

Sim, as empresas publicam políticas, mas quem, no mundo real e agitado, lê tudo isso antes de usar a ferramenta? Menos da metade, mas um número crescente: 48% afirmaram que agora leem políticas de privacidade e relatórios — um aumento em relação aos 43% registrados em 2025.

Além disso, sabemos, pelas notícias recentes, que as empresas estão lançando funcionalidades de IA às pressas, antes mesmo de terem tempo de verificar adequadamente sua segurança.

Um raio de esperança: as pessoas estão agindo

Este resultado da pesquisa chamou nossa atenção.

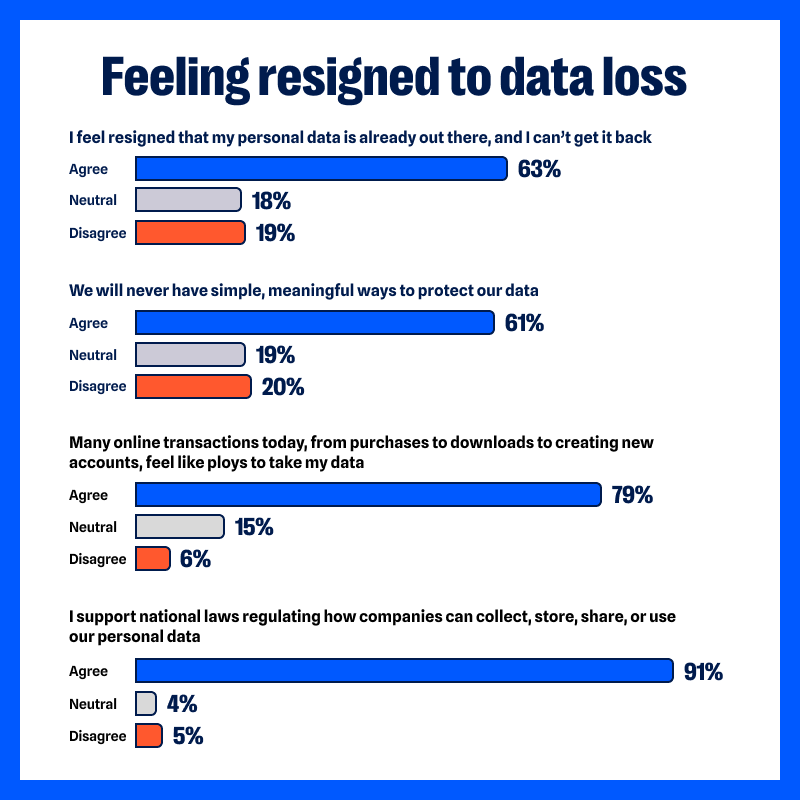

63% dos entrevistados concordaram com a afirmação: “Sinto-me resignado com o fato de que meus dados pessoais já estão por aí e não consigo recuperá-los.”

No ano passado, esse número era de 74%.

Portanto, embora a preocupação com o uso indevido de dados continue alta, menos pessoas se sentem totalmente impotentes.

Os entrevistados relataram ter tomado medidas práticas para limitar a exposição de seus dados.

Algumas pessoas reduziram ou interromperam totalmente o uso de determinadas plataformas devido a preocupações com a privacidade, incluindo redes sociais (44% deixaram de usar Instagram, 37% deixaram de usar Facebook e 49% deixaram de usar o TikTok) e ferramentas de IA (43% deixaram de usar o ChatGPT e 42% deixaram de usar o Gemini).

Outros relataram compartilhar menos informações pessoais online ou evitar assuntos delicados em conversas digitais (88% afirmaram que não compartilham livremente informações pessoais com ferramentas de IA).

Há também um aumento no uso de ferramentas de proteção da privacidade para seus dados, dispositivos e identidades.

- 46% utilizam uma VPN um aumento em relação aos 42% registrados em 2025)

- 40% possuem uma solução de proteção contra roubo de identidade (uma queda em relação aos 43% anteriores)

- 25% utilizam um serviço ou solução de remoção de dados pessoais (um aumento em relação aos 23% anteriores)

- 71% utilizam um bloqueador de anúncios para navegar na internet (um aumento em relação aos 69% anteriores)

- 48% leem políticas de privacidade e relatórios (um aumento em relação aos 43%)

- 76% utilizam a autenticação multifatorial (um aumento em relação aos 69%)

- 82% optam por não permitir a coleta de dados, quando possível (um aumento em relação aos 75% anteriores)

- 38% utilizam dados falsos ou fictícios online sempre que possível (um aumento em relação aos 33%)

Nenhuma dessas medidas apaga os rastros históricos, mas elas limitam novos riscos. David Ruiz, especialista sênior em privacidade da Malwarebytes, afirmou:

“Vinte anos de inovação online levaram muitas empresas a seguirem a mesma direção — contra as pessoas comuns.

Para a maioria das pessoas hoje em dia, as empresas que estão introduzindo ferramentas de IA em seu dia a dia são as mesmas que lucraram com sua capacidade de atenção, invadiram sua privacidade e causaram o vazamento de seus dados. Mas uma força contrária está surgindo.

“Essas pequenas mudanças no comportamento dos usuários devem incentivar outras pessoas a compreender que, mesmo hoje em dia, a privacidade continua sendo possível e vale a pena.”

Privacy pode parecer uma questão de tudo ou nada: ou tudo fica exposto, ou tudo está seguro. Mas trata-se de um processo gradual, e as respostas da pesquisa refletem como as pessoas estão começando a retomar o controle sobre seus dados.

O que isso significa para as empresas

As organizações que incorporam IA em seus produtos enfrentam um público mais complexo do que poderiam ter imaginado inicialmente.

Durante anos, as equipes de produto partiram do princípio de que os usuários estariam dispostos a ceder mais dados em troca de maior comodidade. Mas quando quase nove em cada dez pessoas afirmaram estar preocupadas com o uso de seus dados pela IA sem consentimento, a confiança passou a ser parte integrante do próprio produto. A Mozilla aproveitou essa oportunidade e adicionou um simples botão“desativar IA”ao Firefox.

Já não basta destacar o que a IA é capaz de fazer. Os usuários querem entender o que acontece depois que clicam em “enviar”.

Nós, o povo… queremos leis de privacidade rigorosas

Quando a preocupação atinge o nível observado em nossa pesquisa, isso inevitavelmente levanta a delicada questão da regulamentação.

91% dos entrevistados afirmaram que “apóiam leis nacionais que regulamentem a forma como as empresas podem coletar, armazenar, compartilhar ou utilizar nossos dados pessoais”.

A questão não se resume a uma ferramenta específica, mas sim à sensação de que os limites não estão bem definidos. Os sistemas de IA generativa podem redigir documentos jurídicos, escrever e-mails e processar dados confidenciais com rapidez. Grande parte das estruturas de privacidade existentes nos EUA, na UE e em outras regiões foi elaborada antes de a IA se tornar comum.

Os órgãos reguladores estão tentando se atualizar. A Lei de IA da União Europeia, aprovada em 2024, introduziu uma abordagem baseada no risco para regulamentar determinados sistemas de IA. Nos Estados Unidos, agências federais, incluindo a FTC, emitiram orientações e alertas sobre vigilância comercial e tomada de decisão automatizada, mas o país ainda não possui uma legislação abrangente específica para a privacidade no âmbito da IA.

A demanda por leis e regulamentações nacionais está em seu nível mais alto de todos os tempos. Os consumidores querem limites que sejam compreensíveis e aplicáveis.

O que você pode fazer

É claro que não vamos abandonar toda a tecnologia. A IA não vai desaparecer por conta própria. Ela pode ser bastante útil. Usamos a IA para identificar ameaças e golpes que ninguém viu antes, o que resulta em uma proteção muito melhor. Também utilizamos IA generativa no Scam Guard para oferecer assistência por chat 24 horas por dia, 7 dias por semana (aliada à nossa profunda experiência em pesquisa de ameaças, é claro). Muitas pessoas a utilizam para economizar tempo, redigir documentos ou explorar ideias. Além disso, infelizmente, para criar pequenas caricaturas de si mesmas.

O segredo aqui é o uso criterioso.

- Limite as informações que você fornece a ferramentas públicas de IA, especialmente dados de saúde, dados financeiros e informações confidenciais de clientes.

- Analise as políticas de privacidade e retenção de dados das ferramentas de IA que você usa regularmente.

- Exclua contas e aplicativos que você não precisa mais.

- Verifique as permissões dos aplicativos pelo menos duas vezes por ano.

- Use uma VPN reduzir o rastreamento por parte do seu provedor de internet.

- Remova suas informações dos principais sites de corretores de dados. Verifique se suas informações pessoais estão expostas com uma análise de pegada digital.

- Use um gerenciador de senhas confiável e evite reutilizar senhas em diferentes serviços.

Na Malwarebytes, acreditamos que a privacidade é um direito humano. A proteção dos dados pessoais é indissociável da proteção da segurança pessoal. Quanto mais informações circulam sem supervisão, maior é o risco de uso indevido, fraude e danos.

A IA continuará a se desenvolver. É improvável que essa trajetória diminua o ritmo. A questão é se a confiança crescerá junto com ela.

Informações da pesquisa

Malwarebytes uma pesquisa rápida com os leitores de sua newsletter entre 26 de janeiro e 3 de fevereiro de 2026, por meio da plataforma Alchemer Survey.

No total, 1.235 pessoas responderam, provenientes de 72 países, sendo que a maioria dos participantes era dos EUA, do Reino Unido, do Canadá e da Austrália.