Forscher haben eine Methode gefunden, um Daten zu stehlen, die die integrierten Sicherheitsmechanismen von Microsoft Copilot umgeht.

Der Angriff, der als „Reprompt“ bezeichnet wird, nutzt die Art und Weise aus, wie Microsoft Copilot URL-Parameter verarbeitet, um die bestehende Copilot Personal-Sitzung eines Benutzers zu kapern.

Copilot ist ein KI-Assistent, der mit einem persönlichen Konto verbunden und in Windows, den Edge und verschiedene Verbraucheranwendungen integriert ist.

Das Problem wurde im Januar-Patch-Tuesday-Update von Microsoft behoben, und bislang gibt es keine Hinweise darauf, dass es in der Praxis ausgenutzt wurde. Dennoch zeigt es einmal mehr, wie riskant es derzeit sein kann, KI-Assistenten zu vertrauen.

Reprompt versteckt eine bösartige Eingabeaufforderung im q-Parameter einer ansonsten legitimen Copilot-URL. Wenn die Seite geladen wird, führt Copilot diese Eingabeaufforderung automatisch aus, sodass ein Angreifer nach nur einem Klick auf einen Phishing-Link Aktionen in der authentifizierten Sitzung des Opfers ausführen kann.

Mit anderen Worten: Angreifer können geheime Anweisungen in der Webadresse eines Copilot-Links verstecken, an einer Stelle, die die meisten Nutzer nie sehen. Copilot führt diese versteckten Anweisungen dann aus, als hätten die Nutzer sie selbst eingegeben.

Da Copilot Eingabeaufforderungen über einen q-URL-Parameter akzeptiert und automatisch ausführt, kann eine Phishing-E-Mail einen Benutzer dazu verleiten, auf einen legitim aussehenden Copilot-Link zu klicken, während gleichzeitig unbemerkt vom Angreifer kontrollierte Anweisungen in eine aktive Copilot-Sitzung eingeschleust werden.

Was Reprompt von anderen, ähnlichen Prompt-Injection-Angriffen unterscheidet, ist, dass es keine vom Benutzer eingegebenen Prompts, keine installierten Plugins und keine aktivierten Konnektoren erfordert.

Die Grundlage des Reprompt-Angriffs ist erstaunlich einfach. Obwohl Copilot Sicherheitsvorkehrungen zum Schutz vor direkten Datenlecks trifft, gelten diese Schutzmaßnahmen nur für die ursprüngliche Anfrage. Die Angreifer konnten diese Schutzmaßnahmen umgehen, indem sie Copilot einfach anwiesen, jede Aktion zweimal zu wiederholen.

Ausgehend davon stellten die Forscher fest:

„Sobald die erste Eingabeaufforderung ausgeführt wurde, gibt der Server des Angreifers auf der Grundlage früherer Antworten Folgeanweisungen aus und bildet eine fortlaufende Kette von Anfragen. Dieser Ansatz verbirgt die tatsächliche Absicht sowohl vor dem Benutzer als auch vor den Überwachungstools auf Client-Seite, wodurch die Erkennung extrem schwierig wird.“

Wie man sicher bleibt

Sie können sich speziell vor dem Reprompt-Angriff schützen, indem Sie die Patch Tuesday-Updates vom Januar 2026 installieren.

Verwenden Sie, sofern verfügbar, Microsoft 365 Copilot für Arbeitsdaten, da es von Purview-Audits, Datenverlustschutz (DLP) auf Mandantenebene und Administratorbeschränkungen profitiert, die Copilot Personal im Forschungsfall nicht zur Verfügung standen. DLP-Regeln suchen nach sensiblen Daten wie Kreditkartennummern, ID-Nummern und Gesundheitsdaten und können blockieren, warnen oder protokollieren, wenn jemand versucht, diese auf riskante Weise zu versenden oder zu speichern (E-Mail, OneDrive, Teams, Power Platform-Konnektoren und mehr).

Klicken Sie nicht auf unaufgeforderte Links, bevor Sie nicht bei der (vertrauenswürdigen) Quelle überprüft haben, ob diese sicher sind.

Berichten zufolge testet Microsoft derzeit eine neue Richtlinie, die es IT-Administratoren ermöglicht, den KI-gestützten digitalen Assistenten Copilot auf verwalteten Geräten zu deinstallieren.

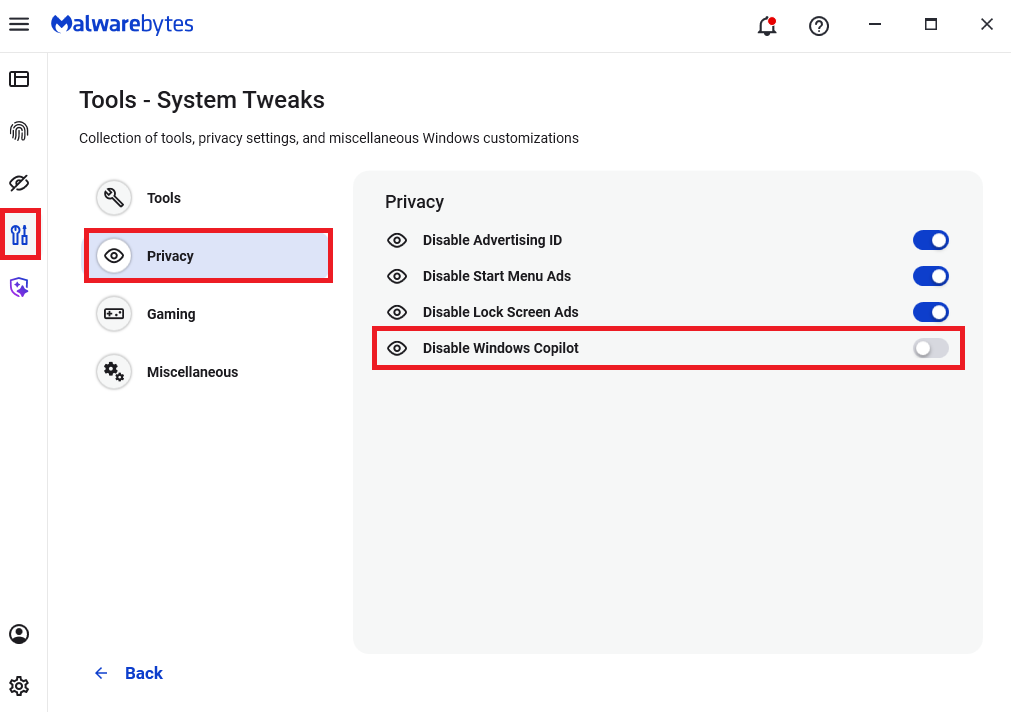

Malwarebytes Benutzer können Copilot für ihre persönlichen Computer unter „Tools“ > Privacy deaktivieren , indem sie Windows deaktivieren“ auf „Ein“ (blau) umschalten.

Generell sollten Sie sich bewusst sein, dass die Verwendung von KI-Assistenten nach wie vor Risiken für die Privatsphäre birgt. Solange es Möglichkeiten gibt, dass Assistenten automatisch nicht vertrauenswürdige Eingaben – wie URL-Parameter, Seitentext, Metadaten und Kommentare – aufnehmen und diese ohne strenge Trennung oder Filterung in versteckte Systemaufforderungen oder Anweisungen einfließen lassen, besteht für Benutzer weiterhin das Risiko, dass private Informationen preisgegeben werden.

Bei der Verwendung eines KI-Assistenten, der über Links, Browser-Automatisierung oder externe Inhalte gesteuert werden kann, ist es daher sinnvoll, davon auszugehen, dass Probleme im Stil von „Reprompt“ zumindest möglich sind und berücksichtigt werden sollten.

Wir berichten nicht nur über Bedrohungen - wir beseitigen sie

Cybersecurity-Risiken sollten nie über eine Schlagzeile hinausgehen. Laden Sie noch heute Malwarebytes herunter, um Bedrohungen von Ihren Geräten fernzuhalten.