Die KI hat sich nicht einfach in unser Leben eingeschlichen. Sie ist durch die Tür hereingestürmt, hat sich an den Tisch gesetzt und angefangen, unsere Sätze zu beenden.

Anstelle einer nützlichen Liste mit Links versucht Google nun, Ihre Frage zu beantworten. Microsofts Copilot entwirft Antworten an Ihren Chef, noch bevor Sie Ihren Kaffee getrunken haben. Ihr Smartphone fasst Gespräche zusammen, an die Sie sich gar nicht mehr erinnern können.

Jedes große Technologieunternehmen bemüht sich, seine Produkte mit KI auszustatten, denn niemand will den Anschluss verpassen. Und die Öffentlichkeit ist oft gezwungen, sich solchen Launen der Unternehmen anzupassen, was auf die zunehmenden Auswirkungen der „Enshittification“ zurückzuführen ist, wie Cory Doctorow im Podcast „Lock and Code“ erläutert.

Die Menschen nutzen KI. Aber sie vertrauen ihr nicht.

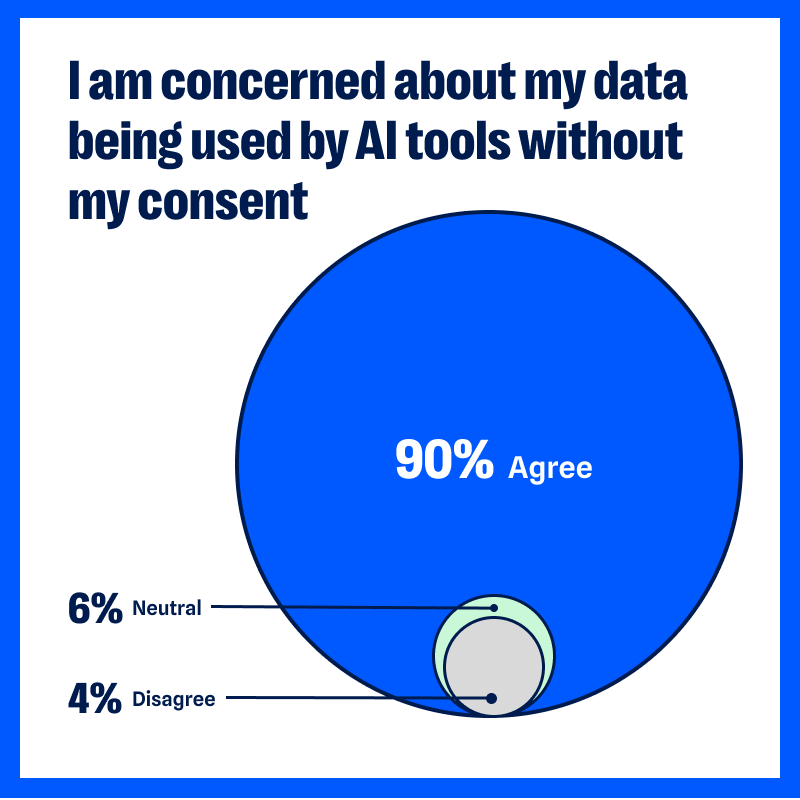

In unserer jüngsten Umfrage zum Thema Datenschutz, für die wir Anfang dieses Jahres 1.200 Antworten von Lesern des Malwarebytes gesammelt haben, gaben 90 % der Befragten an, dass sie Bedenken haben, dass KI ihre Daten ohne ihre Zustimmung verwendet.

Neunzig Prozent.

Das sind nicht nur ein paar Skeptiker. Das sind fast alle, die wir befragt haben. Wir geben zu, dass unsere Stichprobe wahrscheinlich eher aus datenschutzbewussten Personen besteht. Aber 90 % der Menschen, die Malwarebytes folgen, Malwarebytes Sorgen darüber, wie viele persönliche Daten die KI sammelt und was sie damit macht – das ist also ein guter Gradmesser dafür, wie sehr sich jeder darum kümmern sollte.

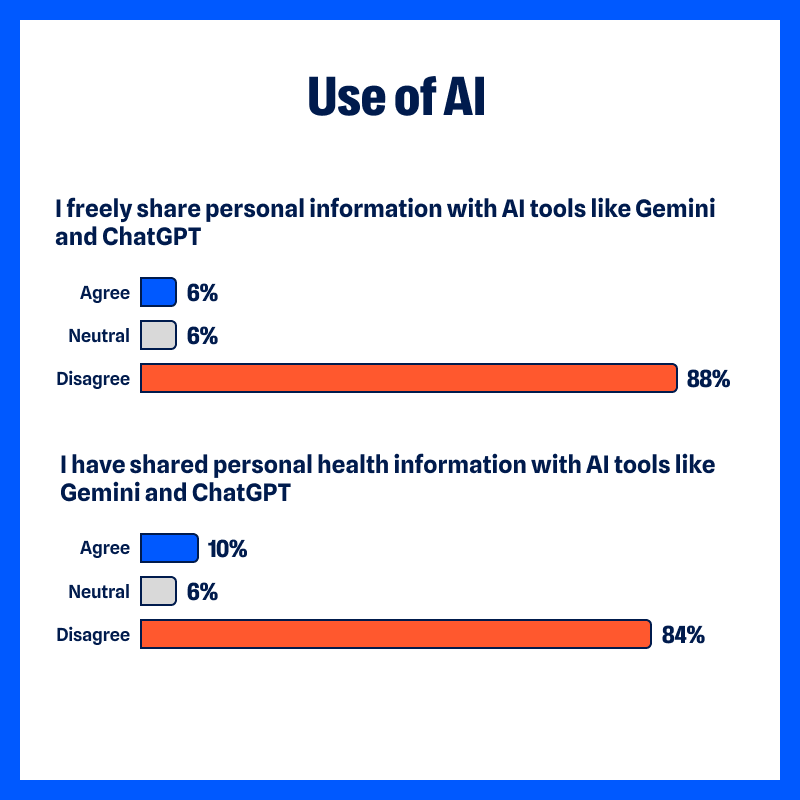

Diese Sorge verändert die Art und Weise, wie Menschen das Internet nutzen:

- 88 % geben „persönliche Daten nicht ohne Weiteres an KI-Tools wie ChatGPT und Gemini weiter“

- 84 % haben „keine persönlichen Gesundheitsdaten an KI-Tools weitergegeben“

- 43 % haben „die Nutzung von ChatGPT eingestellt“

- 42 % haben „die Nutzung von Gemini eingestellt“

Dieses Misstrauen hat nicht erst mit der KI begonnen

Natürlich sorgt KI für Schlagzeilen. Wir berichten über viele davon.

Doch schon seit langem machen sich die Menschen Gedanken darüber, wie sie ihre persönlichen Daten schützen können.

Aus der Umfrage:

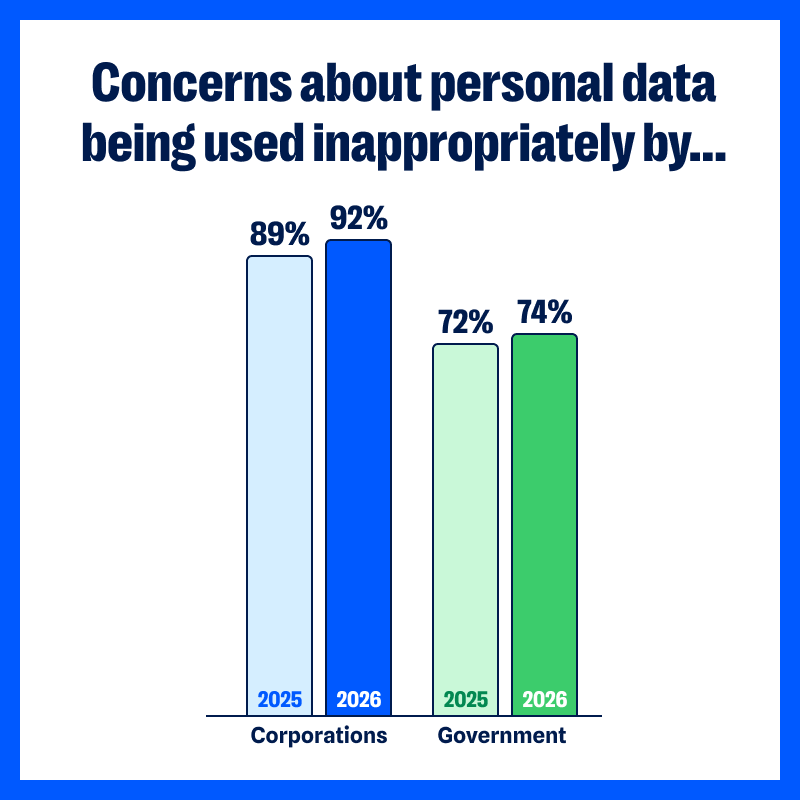

- 92 % sind besorgt darüber, dass ihre „personenbezogenen Daten von Unternehmen missbräuchlich verwendet werden“; dies ist ein leichter Anstieg gegenüber dem Vorjahr (89 % im Jahr 2025)

- 74 % sind besorgt darüber, dass „die Regierung auf ihre personenbezogenen Daten zugreift und diese missbräuchlich verwendet“ (ein Anstieg gegenüber 72 %)

Jahrelange Datenschutzverletzungen, dubiose Tracking-Praktiken und der gefährliche Missbrauch durch Datenbroker haben unser Vertrauen in die Fähigkeit von Organisationen, unsere Daten zu schützen, zunehmend untergraben. Im vergangenen Jahr haben Organisationen im Gesundheitswesen weiterhin von schwerwiegenden Sicherheitslücken berichtet, die sensible Patientendaten betrafen. Die FTC warnte vor „erschreckenden“ kommerziellen Überwachungspraktiken, denen die meisten Verbraucher nie zugestimmt hatten, und laut unserer Umfrage gaben 49 % der Befragten an, dass ihre persönlichen Daten für Betrugsversuche genutzt wurden, die auf sie oder ihre Familie abzielten.

Unterscheidet sich KI wirklich von, sagen wir, sozialen Medien?

Wenn Menschen soziale Medien nutzen, sind sie sich in der Regel bewusst, dass ihre Klicks und Likes erfasst werden. Wenn sie online einkaufen, erwarten sie, dass der Shop ihre Kaufhistorie speichert oder die Artikel nachverfolgt, für die sie sich interessiert haben. Sie verstehen das Konzept der Werbung und erkennen, wie diese in soziale oder kommerzielle Websites eingebunden ist.

KI-Tools unterscheiden sich voneinander, weil wir sie unterschiedlich einsetzen.

Wenn wir Ideen, Notizen aus Kundengesprächen, persönliche Probleme und Fragen zur Gesundheit mit einem KI-Assistenten teilen, behandeln wir ihn wie einen Vertrauten. Vielleicht haben wir für eine Zugangsstufe bezahlt, bei der versprochen wird, dass die Modelle nicht mit unseren Daten trainiert werden. Selbst wenn wir mit dem KI-Chatbot einer Website über Möbelbausätze und fehlende Schrauben plaudern, verhalten wir uns so, als würden wir mit einer anderen Person sprechen – und nicht, als würden wir dieses Gespräch öffentlich übertragen.

Die Interaktion mit der KI wirkt vertraut und dialogorientiert, obwohl uns allen bewusst ist, dass wir mit einem Bot sprechen. Dadurch wird die Unsicherheit darüber, wie diese KI mit den Daten umgeht, die wir ihr zur Verfügung gestellt haben, persönlicher und unmittelbarer.

Wir wissen, dass KI-Assistenten von Unternehmen oft mit anderen Tools verknüpft sind. Wir wissen, dass GPTs von jedem Entwickler oder Betrüger erstellt werden können. (Schaut euch Malwarebytes ChatGPTan – wir gehören zu den Guten). Wir wissen, dass fast jede geschäftliche oder private Plattform mittlerweile über irgendeine Form von KI-basierter Datenerfassung verfügt. Was der Durchschnittsbürger über KI nicht weiß, wirkt beängstigend.

- Wo werden unsere Eingabeaufforderungen gespeichert?

- Werden diese Eingabeaufforderungen zum Trainieren der KI verwendet?

- Wie lange werden sie aufbewahrt?

- Kann jemand innerhalb des Unternehmens diese lesen?

- Kann man sie kaufen? Für Werbezwecke nutzen? Sind sie durchgesickert?…

Ja, Unternehmen veröffentlichen Richtlinien, aber wer liest diese in der realen, hektischen Welt schon alle durch, bevor er das Tool nutzt? Weniger als die Hälfte, aber die Zahl steigt: 48 % gaben an, dass sie mittlerweile Datenschutzrichtlinien und Berichte lesen – ein Anstieg gegenüber 43 % im Jahr 2025.

Außerdem wissen wir aus den jüngsten Schlagzeilen, dass Unternehmen KI-Funktionen auf den Markt bringen, bevor sie Zeit hatten, diese ordnungsgemäß auf ihre Sicherheit zu prüfen.

Ein Funken Hoffnung: Die Menschen werden aktiv

Dieses Ergebnis der Umfrage ist uns besonders aufgefallen.

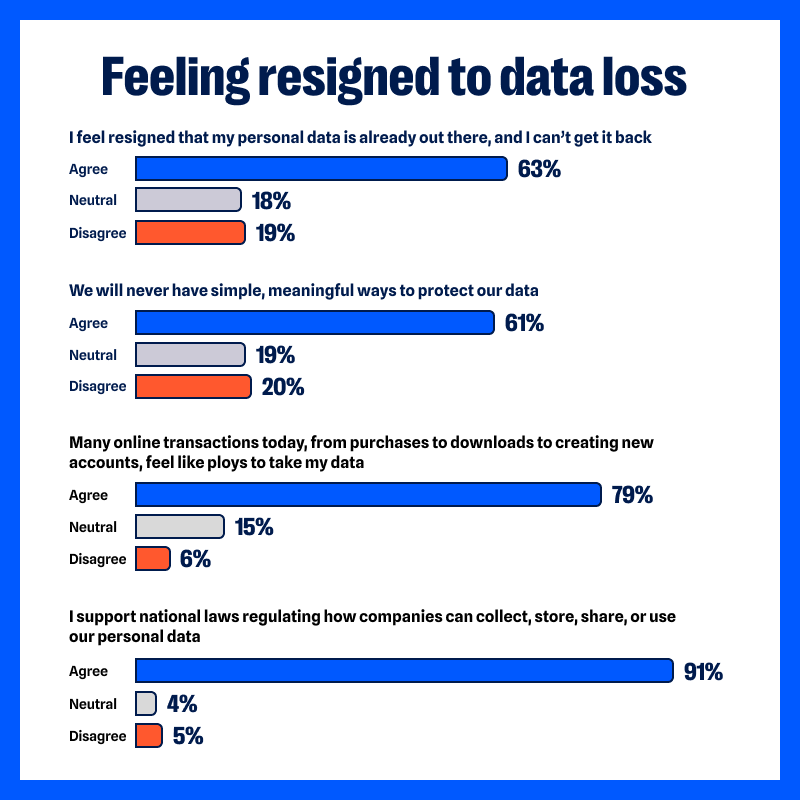

63 % der Befragten stimmten der Aussage zu: „Ich habe mich damit abgefunden, dass meine persönlichen Daten bereits im Umlauf sind und ich sie nicht mehr zurückbekommen kann.“

Im vergangenen Jahr lag dieser Anteil bei 74 %.

Obwohl die Sorge um den Missbrauch von Daten nach wie vor groß ist, fühlen sich weniger Menschen völlig hilflos.

Die Befragten gaben an, konkrete Maßnahmen ergriffen zu haben, um die Offenlegung ihrer Daten einzuschränken.

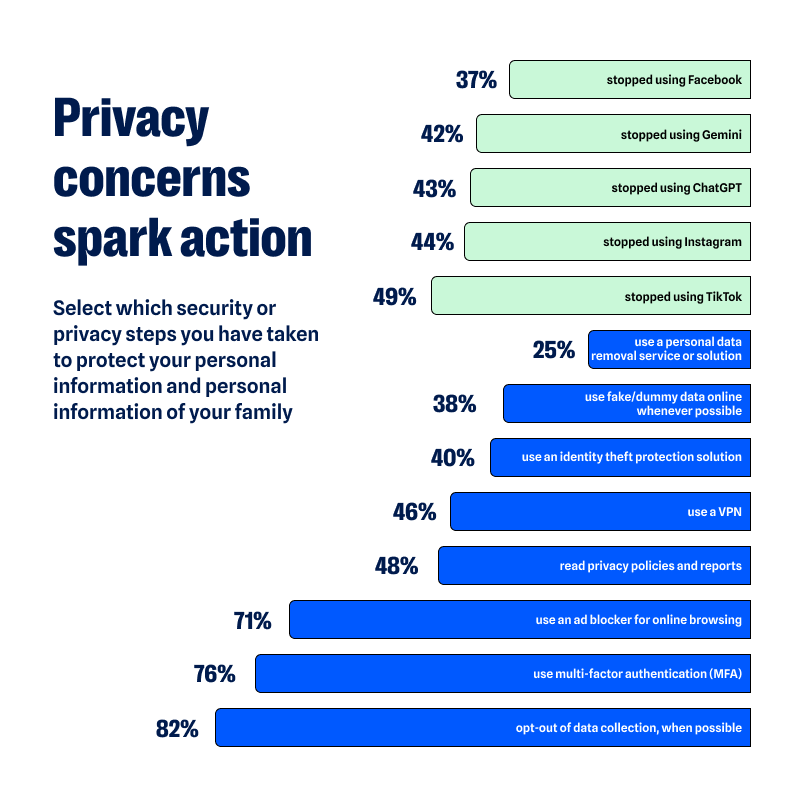

Einige haben die Nutzung bestimmter Plattformen aus Datenschutzgründen eingeschränkt oder ganz eingestellt, darunter soziale Medien (44 % nutzen Instagram nicht mehr, 37 % nutzen Facebook nicht mehr und 49 % nutzen TikTok nicht mehr) sowie KI-Tools (43 % nutzen ChatGPT nicht mehr, 42 % nutzen Gemini nicht mehr).

Andere gaben an, online weniger persönliche Informationen preiszugeben oder sensible Themen in digitalen Gesprächen zu vermeiden (88 % sagten, sie würden persönliche Informationen nicht ohne Weiteres an KI-Tools weitergeben).

Zudem werden zunehmend Tools zum Schutz der Privatsphäre für ihre Daten, Geräte und Identitäten eingesetzt.

- 46 % nutzen ein VPN ein Anstieg gegenüber 42 % im Jahr 2025)

- 40 % verfügen über eine Lösung zum Schutz vor Identitätsdiebstahl (ein Rückgang gegenüber 43 %)

- 25 % nutzen einen Dienst oder eine Lösung zur Löschung personenbezogener Daten (ein Anstieg gegenüber 23 %)

- 71 % nutzen beim Surfen im Internet einen Werbeblocker (ein Anstieg gegenüber 69 %)

- 48 % lesen Datenschutzrichtlinien und Berichte (ein Anstieg gegenüber 43 %)

- 76 % nutzen MFA (ein Anstieg gegenüber 69 %)

- 82 % lehnen die Datenerhebung nach Möglichkeit ab (ein Anstieg gegenüber 75 %)

- 38 % verwenden online, wann immer möglich, gefälschte oder Scheindaten (ein Anstieg gegenüber 33 %)

Keine dieser Maßnahmen löscht historische Datenspuren, doch sie begrenzen das Risiko, erneut kompromittiert zu werden. David Ruiz, leitender Datenschutzbeauftragter bei Malwarebytes, sagte:

„Zwanzig Jahre Online-Innovation haben zu viele Unternehmen in dieselbe Richtung gelenkt – gegen die einfachen Menschen.“

Für die meisten Menschen sind die Unternehmen, die ihnen KI-Tools in den Alltag drängen, heute dieselben, die ihre Aufmerksamkeitsspanne zu Geld gemacht, in ihre Privatsphäre eingedrungen sind und ihre Daten durch Sicherheitslücken preisgegeben haben. Doch es bildet sich eine Gegenbewegung.

„Diese kleinen Veränderungen im Nutzerverhalten sollten anderen verdeutlichen, dass Datenschutz auch heute noch möglich und sinnvoll ist.“

Privacy kann sich wie eine Schwarz-Weiß-Situation anfühlen: Entweder ist alles offen zugänglich oder alles ist sicher. Doch es handelt sich um einen schrittweisen Prozess, und die Umfrageergebnisse zeigen, wie die Menschen beginnen, die Kontrolle über ihre Daten zurückzugewinnen.

Was dies für Unternehmen bedeutet

Unternehmen, die KI in ihre Produkte integrieren, sehen sich mit einer komplexeren Zielgruppe konfrontiert, als sie zunächst angenommen hatten.

Jahrelang gingen Produktteams davon aus, dass Nutzer bereit wären, mehr Daten für mehr Komfort preiszugeben. Doch da fast neun von zehn Menschen angaben, sie hätten Bedenken, dass KI ihre Daten ohne ihre Zustimmung nutze, wird Vertrauen zu einem wesentlichen Bestandteil des Produkts selbst. Mozilla hat darauf reagiert und Firefox um eine einfache Schaltflächezum Deaktivieren der KIerweitert.

Es reicht nicht mehr aus, nur darauf hinzuweisen, was KI leisten kann. Die Nutzer möchten wissen, was passiert, nachdem sie auf „Absenden“ geklickt haben.

Wir, das Volk … wollen strenge Datenschutzgesetze

Wenn die Besorgnis ein solches Ausmaß erreicht, wie wir es in unserer Umfrage festgestellt haben, wirft dies unweigerlich die heikle Frage nach einer Regulierung auf.

91 % der Befragten gaben an, dass sie „nationale Gesetze befürworten, die regeln, wie Unternehmen unsere personenbezogenen Daten erheben, speichern, weitergeben oder nutzen dürfen“.

Es geht weniger um ein einzelnes Tool als vielmehr um das Gefühl, dass die Rahmenbedingungen unklar sind. Generative KI-Systeme können Rechtsdokumente entwerfen, E-Mails verfassen und sensible Daten in kürzester Zeit verarbeiten. Ein Großteil der bestehenden Datenschutzregelungen in den USA, der EU und anderen Regionen wurde verfasst, bevor KI alltäglich war.

Die Regulierungsbehörden versuchen, den Rückstand aufzuholen. Mit dem 2024 verabschiedeten KI-Gesetz der Europäischen Union wurde ein risikobasierter Ansatz für die Regulierung bestimmter KI-Systeme eingeführt. In den USA haben Bundesbehörden, darunter die FTC, Leitlinien und Warnungen zu kommerzieller Überwachung und automatisierter Entscheidungsfindung herausgegeben, doch es gibt dort noch kein umfassendes, speziell auf KI ausgerichtetes Datenschutzgesetz.

Der Wunsch nach nationalen Gesetzen und Vorschriften ist so groß wie nie zuvor. Die Verbraucher wünschen sich klare und durchsetzbare Regeln.

Was Sie tun können

Wir werden natürlich nicht auf jegliche Technologie verzichten. KI wird sich nicht selbst verdrängen. Sie kann sehr nützlich sein. Wir nutzen KI, um bisher unbekannte Bedrohungen und Betrugsversuche aufzudecken, was zu einem deutlich besseren Schutz führt. Außerdem setzen wir in Scam Guard generative KI ein, um rund um die Uhr Chat-Unterstützung anzubieten (natürlich in Verbindung mit unserer fundierten Expertise in der Bedrohungsforschung). Viele Menschen nutzen sie, um Zeit zu sparen, Dokumente zu entwerfen oder Ideen zu entwickeln. Leider auch, um kleine Karikaturen von sich selbst zu erstellen.

Der Schlüssel liegt hier in einem durchdachten Einsatz.

- Geben Sie nur begrenzte Informationen an öffentliche KI-Tools weiter, insbesondere keine Gesundheitsdaten, Finanzdaten und keine vertraulichen Kundendaten.

- Lesen Sie die Datenschutz- und Aufbewahrungsrichtlinien der KI-Tools durch, die Sie regelmäßig nutzen.

- Löschen Sie Konten und Apps, die Sie nicht mehr benötigen.

- Überprüfen Sie die App-Berechtigungen mindestens zweimal im Jahr.

- Verwenden Sie ein VPN die Nachverfolgung durch Ihren Internetanbieter VPN verringern.

- Lassen Sie Ihre Daten von den wichtigsten Datenbroker-Websites entfernen. Prüfen Sie mit einem Digital-Footprint-Scan, ob Ihre persönlichen Daten öffentlich zugänglich sind.

- Verwenden Sie einen seriösen Passwort-Manager und vermeiden Sie es, Passwörter für verschiedene Dienste wiederzuverwenden.

Wir bei Malwarebytes sind der Überzeugung, dass Datenschutz ein Menschenrecht ist. Der Schutz personenbezogener Daten ist untrennbar mit dem Schutz der persönlichen Sicherheit verbunden. Je mehr Informationen ohne Kontrolle im Umlauf sind, desto größer ist die Gefahr von Missbrauch, Betrug und Schaden.

Die KI wird sich weiterentwickeln. Es ist unwahrscheinlich, dass sich dieser Trend verlangsamen wird. Die Frage ist, ob das Vertrauen in ihr ebenfalls wachsen wird.

Informationen zur Umfrage

Malwarebytes zwischen dem 26. Januar und dem 3. Februar 2026 über die Umfrageplattform Alchemer eine Blitzumfrage unter den Abonnenten seines Newsletters Malwarebytes .

Insgesamt nahmen 1.235 Personen aus 72 Ländern an der Umfrage teil, wobei die meisten Befragten aus den USA, Großbritannien, Kanada und Australien stammten.