L'IA ne s'est pas simplement immiscée dans nos vies. Elle a fait irruption, s'est installée à table et s'est mise à finir nos phrases.

Au lieu de vous proposer une liste utile de liens, Google essaie désormais de répondre à votre question. Copilot, de Microsoft, rédige des réponses à l'intention de votre patron avant même que vous ayez bu votre café. Votre téléphone résume des conversations dont vous ne vous souvenez même pas.

Toutes les grandes entreprises technologiques se livrent à une course effrénée pour intégrer l'IA à leurs produits, car personne ne veut se faire distancer. Et le grand public est souvent contraint de s'adapter à ces caprices des entreprises en raison des effets croissants de la « merdification », comme l'explique Cory Doctorow dans le podcast Lock and Code.

Les gens utilisent l'IA. Mais ils ne lui font pas confiance.

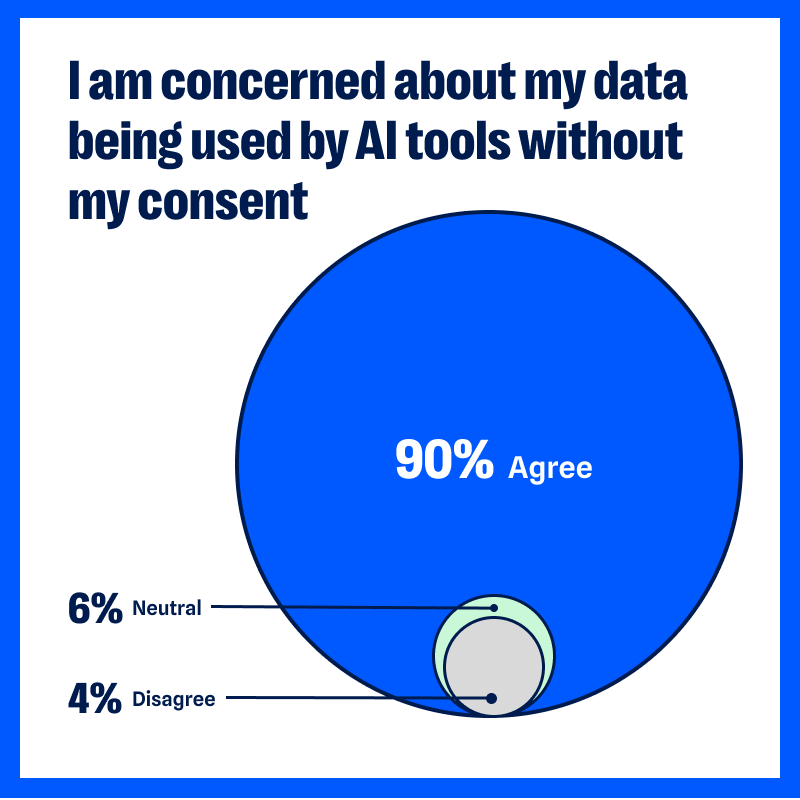

Dans notre dernière enquête « Privacy Pulse », menée en début d'année auprès des lecteurs de la Malwarebytes et qui a recueilli 1 200 réponses, 90 % des personnes interrogées ont déclaré craindre que l'IA n'utilise leurs données sans leur consentement.

Quatre-vingt-dix pour cent.

Ce ne sont pas quelques sceptiques. C'est pratiquement toutes les personnes à qui nous avons posé la question. Nous l'admettons, notre échantillon est sans doute biaisé en faveur des personnes soucieuses de la protection de leurs données. Mais 90 % des abonnés de Malwarebytes de la quantité de données personnelles que l'IA absorbe et de ce qu'elle va en faire ; c'est donc un bon indicateur de l'importance que tout le monde devrait y accorder.

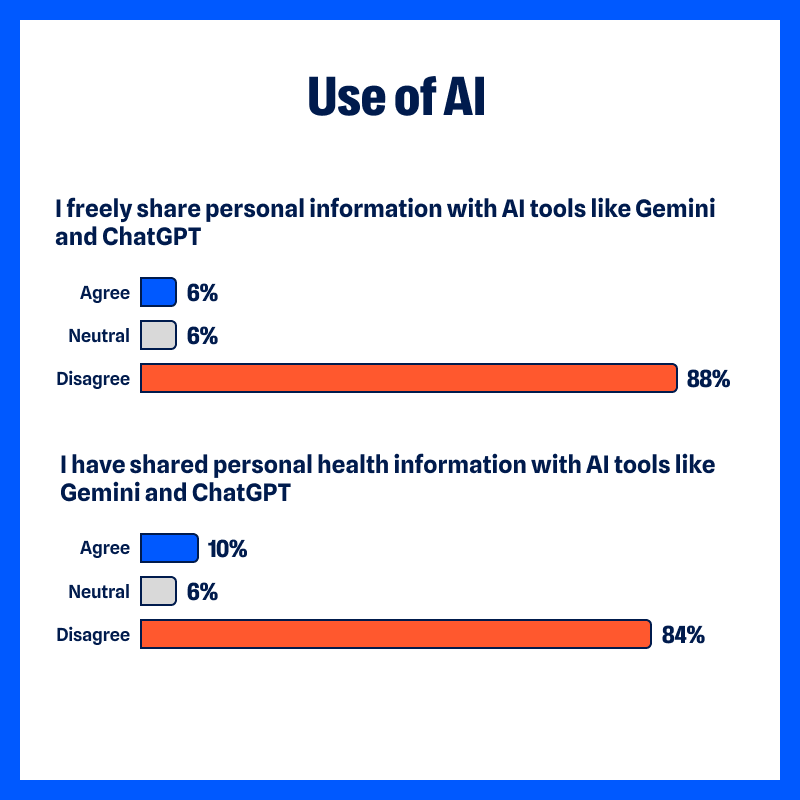

Cette préoccupation modifie la façon dont les gens utilisent Internet :

- 88 % des personnes interrogées ne « partagent pas librement leurs informations personnelles avec des outils d'IA tels que ChatGPT et Gemini »

- 84 % n'ont pas « partagé d'informations personnelles relatives à leur santé avec des outils d'IA »

- 43 % ont « cessé d'utiliser ChatGPT »

- 42 % ont « cessé d'utiliser Gemini »

Cette méfiance ne date pas de l'avènement de l'IA

Bien sûr, l'IA fait la une de tous les journaux. Nous parlons souvent de ce sujet.

Mais cela fait longtemps que les gens s'inquiètent de la conservation de leurs données personnelles.

D'après l'enquête :

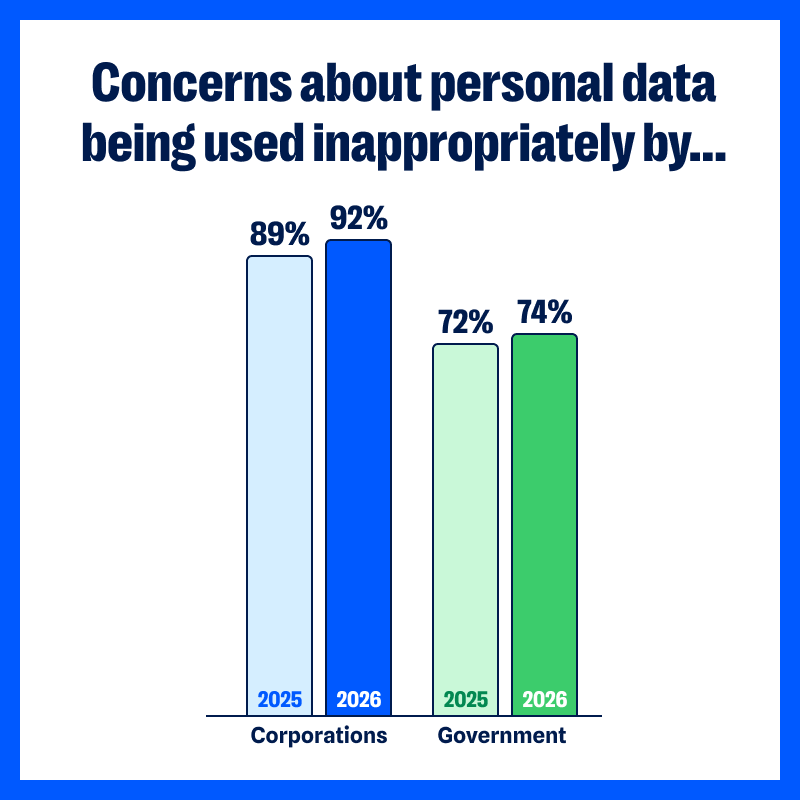

- 92 % des personnes interrogées s'inquiètent de ce que « leurs données personnelles soient utilisées de manière inappropriée par les entreprises », ce qui représente une légère hausse par rapport à l'année dernière (89 % en 2025)

- 74 % s'inquiètent de voir « leurs données personnelles consultées et utilisées de manière inappropriée par les pouvoirs publics » (contre 72 % auparavant)

Des années de fuites de données, de pratiques de suivi douteuses et d'utilisation abusive et dangereuse par les courtiers en données ont progressivement érodé notre confiance dans la capacité des organisations à protéger nos données. Au cours de l'année écoulée, les organismes de santé ont continué de signaler des failles de sécurité majeures affectant les données sensibles des patients. La FTC a mis en garde contre des pratiques de surveillance commerciale « stupéfiantes » auxquelles la plupart des consommateurs n'ont jamais consenti et, selon notre enquête, 49 % des personnes interrogées ont déclaré que leurs informations personnelles avaient été utilisées dans le cadre d'escroqueries les ciblant, elles ou leur famille.

L'IA est-elle vraiment différente, par exemple, des réseaux sociaux ?

Lorsque les gens utilisent les réseaux sociaux, ils savent généralement que leurs clics et leurs « j'aime » sont suivis. Lorsqu'ils font des achats en ligne, ils s'attendent à ce que la boutique conserve l'historique de leurs achats ou garde une trace des articles qui les ont intéressés. Ils comprennent le principe de la publicité et voient comment celle-ci s'intègre aux sites web sociaux ou commerciaux.

Les outils d'IA sont différents parce que nous les utilisons différemment.

Lorsque nous partageons des idées, des notes de réunion avec des clients, des dilemmes personnels ou des questions de santé avec un assistant IA, nous le considérons comme un confident. Peut-être avons-nous souscrit à un niveau d’accès qui garantit que ses modèles ne seront pas entraînés à partir de nos données. Même lorsque nous discutons de meubles en kit et de vis manquantes avec le chatbot IA d’un site web, nous agissons comme si nous parlions à une autre personne, et non comme si nous diffusions cette conversation au monde entier.

L'interaction avec l'IA semble intime et conviviale, même si nous savons tous que nous parlons à un robot. Cela rend l'incertitude quant à la manière dont cette IA traite les données que nous lui avons fournies plus personnelle, plus immédiate.

Nous savons que les assistants IA proposés par les entreprises sont souvent intégrés à d'autres outils. Nous savons que n'importe quel développeur ou escroc peut créer des modèles GPT. (Jetez un œil à Malwarebytes ChatGPT: nous faisons partie des « gentils »). Nous savons que presque toutes les plateformes, qu'elles soient professionnelles ou personnelles, intègrent désormais un élément de collecte de données basé sur l'IA. Ce que le grand public ignore à propos de l'IA peut faire peur.

- Où sont stockées nos invites ?

- Ces invites servent-elles à entraîner l'IA ?

- Combien de temps sont-ils conservés ?

- Y a-t-il quelqu'un au sein de l'entreprise qui puisse les lire ?

- Peut-on les acheter ? Les utiliser à des fins publicitaires ? Ont-elles fait l'objet d'une fuite ?…

Certes, les entreprises publient des politiques, mais dans la réalité d'un quotidien bien rempli, qui prend le temps de les lire avant d'utiliser l'outil ? Moins de la moitié, mais ce chiffre est en hausse : 48 % des personnes interrogées déclarent désormais lire les politiques de confidentialité et les rapports, contre 43 % en 2025.

De plus, comme l'ont montré les gros titres récents, les entreprises se précipitent pour lancer des fonctionnalités d'IA avant même d'avoir eu le temps de les soumettre à des contrôles de sécurité rigoureux.

Une lueur d'espoir : les gens passent à l'action

Ce résultat de l'enquête a retenu notre attention.

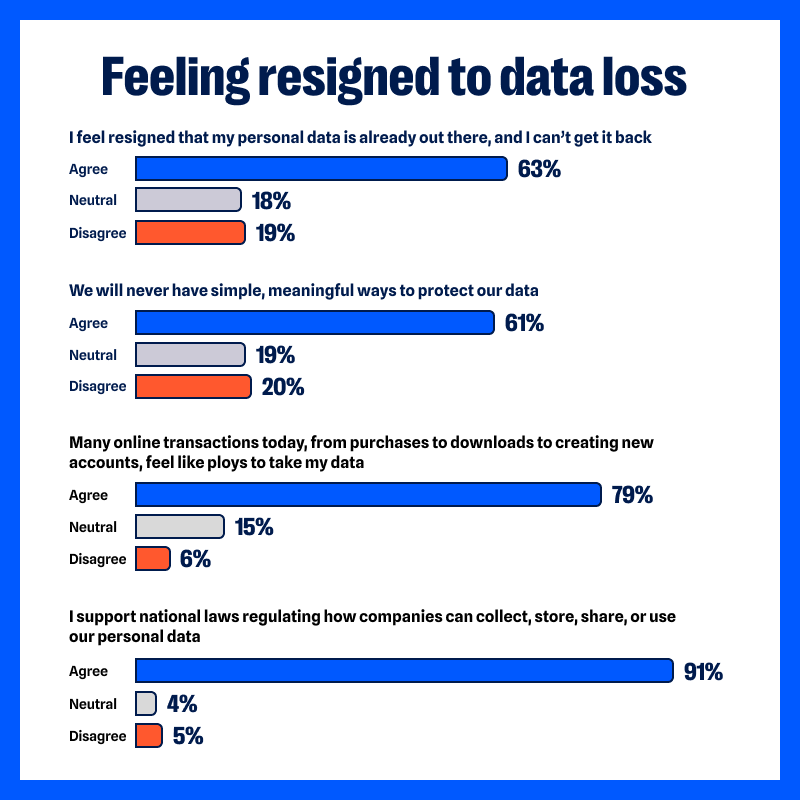

63 % des personnes interrogées se sont dites d'accord avec l'affirmation suivante : « Je me suis résigné(e) à l'idée que mes données personnelles ont déjà été divulguées et que je ne peux pas les récupérer. »

L'année dernière, ce chiffre s'élevait à 74 %.

Ainsi, même si les inquiétudes concernant l'utilisation abusive des données restent vives, moins de personnes se sentent totalement impuissantes.

Les personnes interrogées ont indiqué avoir pris des mesures concrètes pour limiter l'exposition de leurs données.

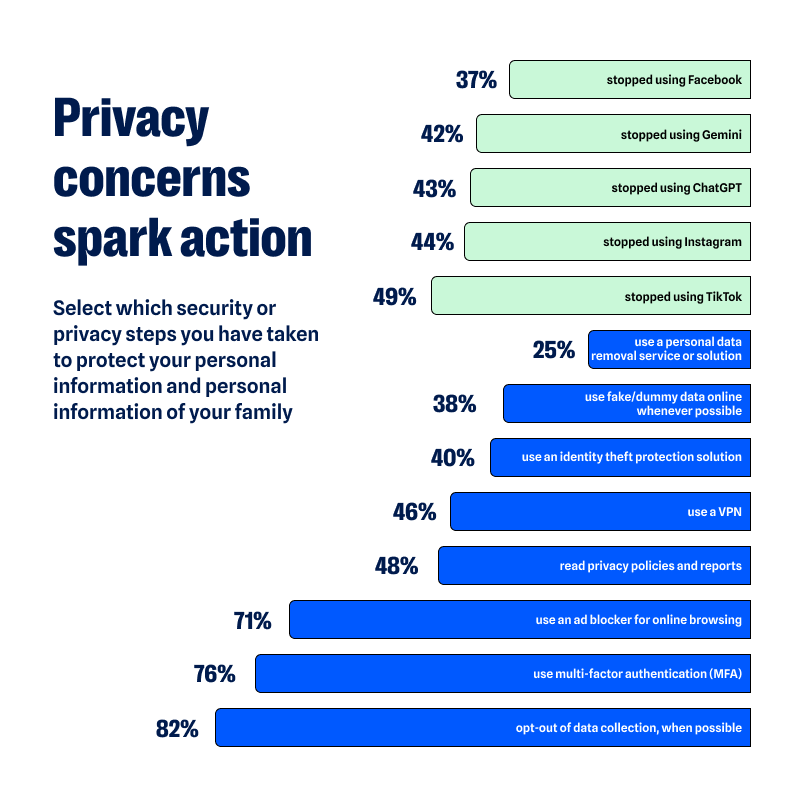

Certains ont réduit ou complètement cessé d'utiliser certaines plateformes pour des raisons liées à la protection de la vie privée, notamment les réseaux sociaux (44 % ont cessé d'utiliser Instagram, 37 % ont cessé d'utiliser Facebook et 49 % ont cessé d'utiliser TikTok) et les outils d'IA (43 % ont cessé d'utiliser ChatGPT, 42 % ont cessé d'utiliser Gemini).

D'autres ont indiqué qu'ils partageaient moins d'informations personnelles en ligne ou qu'ils évitaient les sujets sensibles dans leurs conversations numériques (88 % ont déclaré ne pas partager librement d'informations personnelles avec les outils d'IA).

On observe également un recours accru à des outils de protection de la vie privée pour leurs données, leurs appareils et leurs identités.

- 46 % utilisent un VPN contre 42 % en 2025)

- 40 % disposent d'une solution de protection contre l'usurpation d'identité (contre 43 % auparavant)

- 25 % ont recours à un service ou à une solution de suppression des données personnelles (contre 23 % auparavant)

- 71 % utilisent un bloqueur de publicités pour naviguer sur Internet (contre 69 % auparavant)

- 48 % des personnes interrogées lisent les politiques de confidentialité et les rapports (contre 43 % auparavant)

- 76 % utilisent l'authentification multifactorielle (contre 69 % auparavant)

- 82 % des utilisateurs choisissent de ne pas consentir à la collecte de données, lorsque cela est possible (contre 75 % auparavant)

- 38 % utilisent des données fictives ou factices en ligne dès que possible (contre 33 % auparavant)

Aucune de ces mesures n'efface les traces laissées par les données historiques, mais elles limitent les nouveaux risques d'exposition. David Ruiz, responsable de la protection de la vie privée chez Malwarebytes, a déclaré :

« Vingt ans d'innovation en ligne ont conduit trop d'entreprises à suivre la même voie, au détriment des gens ordinaires. »

Pour la plupart des gens aujourd’hui, les entreprises qui imposent des outils d’IA dans leur quotidien sont les mêmes qui ont monétisé leur capacité d’attention, porté atteinte à leur vie privée et laissé leurs données victimes de fuites. Mais une force d’opposition est en train de voir le jour.

« Ces petits changements dans le comportement des utilisateurs devraient inciter les autres à comprendre que, même aujourd’hui, la protection de la vie privée reste possible et vaut la peine d’être préservée. »

Privacy peut sembler être une question binaire : soit tout est exposé, soit tout est sécurisé. Mais il s'agit d'un processus progressif, et les réponses à l'enquête montrent que les gens commencent à reprendre le contrôle de leurs données.

Ce que cela signifie pour les entreprises

Les entreprises qui intègrent l'IA dans leurs produits se trouvent confrontées à un public plus complexe qu'elles ne l'auraient imaginé au départ.

Pendant des années, les équipes produit ont supposé que les utilisateurs étaient prêts à céder davantage de données en échange d'un plus grand confort d'utilisation. Mais alors que près de neuf personnes sur dix se disent préoccupées par le fait que l'IA utilise leurs données sans leur consentement, la confiance devient un élément à part entière du produit lui-même. Mozilla a saisi cette opportunité et a ajouté un simple bouton« Désactiver l'IA »à Firefox.

Il ne suffit plus de mettre en avant ce que l'IA est capable de faire. Les utilisateurs veulent comprendre ce qui se passe une fois qu'ils ont cliqué sur « Envoyer ».

Nous, le peuple… voulons des lois strictes en matière de protection de la vie privée

Lorsque l'inquiétude atteint le niveau que nous avons constaté dans notre enquête, cela soulève inévitablement la question épineuse de la réglementation.

91 % des personnes interrogées ont déclaré « soutenir les lois nationales régissant la manière dont les entreprises peuvent collecter, stocker, partager ou utiliser nos données personnelles ».

Le problème ne réside pas tant dans un outil en particulier que dans le sentiment que les limites ne sont pas clairement définies. Les systèmes d'IA générative sont capables de rédiger des documents juridiques, d'écrire des e-mails et de traiter des données sensibles à grande vitesse. La plupart des cadres réglementaires en matière de protection de la vie privée en vigueur aux États-Unis, dans l'Union européenne et dans d'autres régions ont été élaborés avant que l'IA ne se généralise.

Les autorités de régulation tentent de rattraper leur retard. La loi européenne sur l'IA, adoptée en 2024, a instauré une approche fondée sur les risques pour réglementer certains systèmes d'IA. Aux États-Unis, des agences fédérales, dont la FTC, ont publié des recommandations et des avertissements concernant la surveillance commerciale et la prise de décision automatisée, mais il n'existe pas encore de législation complète en matière de protection de la vie privée spécifique à l'IA.

La demande en matière de lois et de réglementations nationales n'a jamais été aussi forte. Les consommateurs souhaitent disposer de règles claires et applicables.

Ce que vous pouvez faire

Il est évident que nous n'allons pas renoncer à toute technologie. L'IA ne va pas disparaître d'elle-même. Elle peut s'avérer très utile. Nous utilisons l'IA pour détecter des menaces et des escroqueries inédites, ce qui nous permet d'offrir une bien meilleure protection. Nous utilisons également l'IA générative dans Scam Guard pour fournir une assistance par chat 24 heures sur 24, 7 jours sur 7 (en combinaison avec notre expertise approfondie en matière de recherche sur les menaces, bien sûr). Beaucoup de gens l'utilisent pour gagner du temps, rédiger des documents ou explorer des idées. Et aussi, malheureusement, pour créer de petites caricatures d'eux-mêmes.

Le secret, c'est d'en faire un usage judicieux.

- Limitez les informations que vous communiquez aux outils d'IA accessibles au public, en particulier les données relatives à la santé, les données financières et les informations sensibles concernant vos clients.

- Consultez les politiques de confidentialité et de conservation des données des outils d'IA que vous utilisez régulièrement.

- Supprimez les comptes et les applications dont vous n'avez plus besoin.

- Vérifiez les autorisations des applications au moins deux fois par an.

- Utilisez un VPN limiter le suivi exercé par votre fournisseur d'accès à Internet.

- Supprimez vos données des principaux sites de courtage de données. Vérifiez si vos informations personnelles sont exposées grâce à une analyse de votre empreinte numérique.

- Utilisez un gestionnaire de mots de passe fiable et évitez de réutiliser les mêmes mots de passe sur différents services.

Chez Malwarebytes, nous considérons que la vie privée est un droit fondamental. La protection des données personnelles va de pair avec la protection de la sécurité des personnes. Plus les informations circulent sans contrôle, plus les risques d'abus, de fraude et de préjudice sont élevés.

L'intelligence artificielle va continuer à se développer. Cette évolution ne devrait pas ralentir. La question est de savoir si la confiance va suivre le même rythme.

Informations relatives à l'enquête

Malwarebytes une enquête rapide auprès des lecteurs de sa newsletter entre le 26 janvier et le 3 février 2026, via la plateforme Alchemer Survey.

Au total, 1 235 personnes ont répondu, provenant de 72 pays, la plupart des participants étant originaires des États-Unis, du Royaume-Uni, du Canada et d'Australie.