Jak bardzo czujesz się komfortowo, dzieląc się swoją historią medyczną z AI?

Ja na pewno nie.

Ogłoszenie OpenAI dotyczące nowego programu ChatGPT Health wywołało dyskusję na temat prywatności danych i sposobu, w jaki firma zamierza zapewnić bezpieczeństwo informacji przekazywanych przez użytkowników.

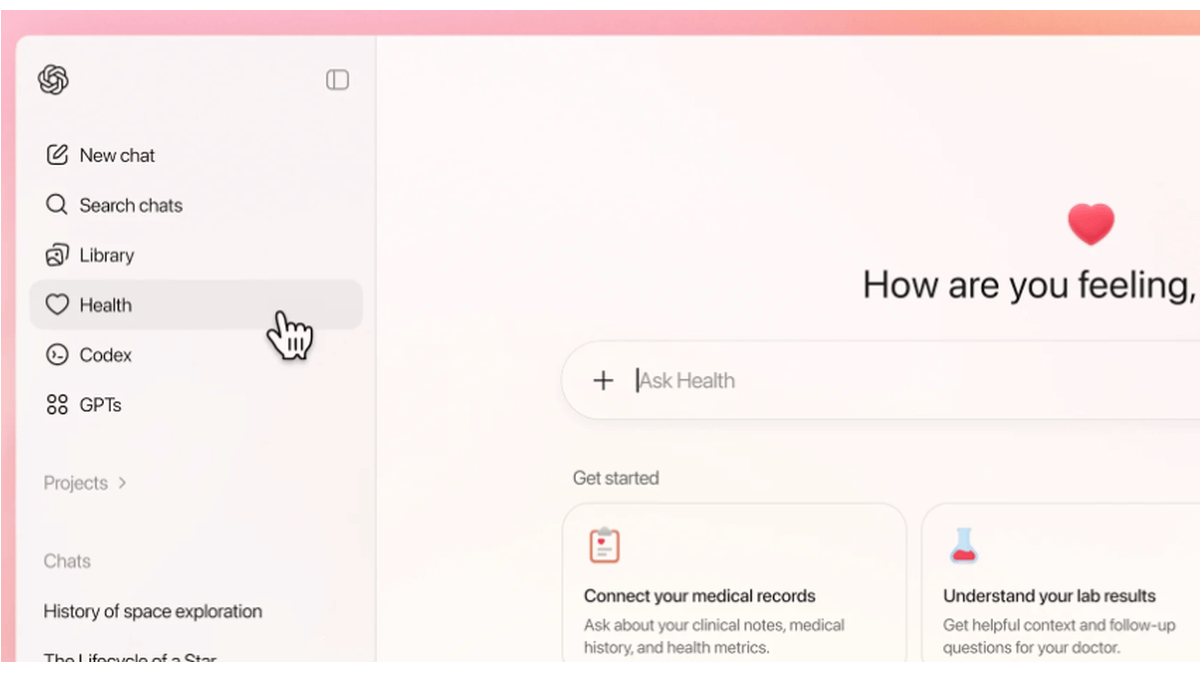

ChatGPT Health to specjalna „przestrzeń zdrowotna” w ramach ChatGPT, która umożliwia użytkownikom połączenie swoich danych medycznych i aplikacji związanych ze zdrowiem, dzięki czemu model może udzielać bardziej spersonalizowanych odpowiedzi na pytania dotyczące zdrowia i dobrego samopoczucia.

OpenAI obiecuje dodatkowe, wielopoziomowe zabezpieczenia zaprojektowane specjalnie dla sektora zdrowia, „aby zapewnić ochronę i poufność rozmów dotyczących zdrowia”.

Po pierwsze, należy pamiętać, że nie jest to system diagnostyczny ani terapeutyczny. Jest to narzędzie pomocnicze, które ułatwia zrozumienie informacji dotyczących zdrowia i przygotowanie się do leczenia.

Jednak właśnie ta część budziła pytania i wątpliwości:

„Możesz bezpiecznie połączyć dokumentację medyczną i aplikacje wellness, aby opierać rozmowy na własnych informacjach zdrowotnych, dzięki czemu odpowiedzi będą bardziej trafne i przydatne dla Ciebie”.

Innymi słowy, ChatGPT Health umożliwia połączenie dokumentacji medycznej i aplikacji, takich jak Apple Health, MyFitnessPal i inne, dzięki czemu system może wyjaśniać wyniki badań laboratoryjnych, śledzić trendy (np. poziom cholesterolu) oraz pomagać w przygotowywaniu pytań do lekarzy lub porównywaniu opcji ubezpieczenia na podstawie danych dotyczących zdrowia.

Biorąc pod uwagę nasze zastrzeżenia dotyczące ogólnego stanu bezpieczeństwa sztucznej inteligencji, a w szczególności chatbotów, nie mam odwagi przekroczyć tej granicy. Na razie jednak nie mam nawet takiej możliwości, ponieważ tylko użytkownicy posiadający plany ChatGPT Free, Go, Plus i Pro spoza Europejskiego Obszaru Gospodarczego, Szwajcarii i Wielkiej Brytanii mogą zapisać się na listę oczekujących.

OpenAI korzysta wyłącznie z partnerów i aplikacji w ChatGPT Health, które spełniają wymagania OpenAI dotyczące prywatności i bezpieczeństwa, co z założenia przenosi dużą część zaufania na samą aplikację ChatGPT Health.

Użytkownicy powinni zdawać sobie sprawę, że informacje dotyczące zdrowia są bardzo wrażliwe, a jak powiedziała Sara Geoghegan, starszy doradca w Electronic Privacy Center, w wywiadzie dla The Record: udostępniając swoje elektroniczne dokumentacje medyczne ChatGPT Health, użytkownicy w Stanach Zjednoczonych mogą skutecznie pozbawić te dokumentacje ochrony HIPAA, co jest poważną kwestią dla każdego, kto udostępnia dane medyczne.

Dodała:

„ChatGPT jest związany wyłącznie własnymi oświadczeniami i obietnicami, więc bez żadnych znaczących ograniczeń, takich jak regulacje lub przepisy prawne, ChatGPT może w dowolnym momencie zmienić warunki świadczenia usług”.

Jeśli zdecydujesz się wypróbować tę nową funkcję, radzimy zachować ostrożność i wziąć sobie do serca radę, aby włączyć 2FA dla ChatGPT. OpenAI twierdzi, że 230 milionów użytkowników już co tydzień zadaje ChatGPT pytania dotyczące zdrowia i dobrego samopoczucia. Zachęcam ich, aby zrobili to samo.

Twoje imię i nazwisko, adres oraz numer telefonu są prawdopodobnie już w sprzedaży.

Firmy zajmujące się handlem danymi gromadzą i sprzedają Twoje dane osobowe każdemu, kto jest skłonny za nie zapłacić.Personal Data Remover Malwarebytes Personal Data Remover je i usuwa Twoje dane, a następnie czuwa nad tym, by tak pozostało.