Sztuczna inteligencja nie wkradła się do naszego życia. Wpadła przez drzwi, usiadła przy stole i zaczęła dokańczać nasze zdania.

Zamiast przydatnej listy linków Google próbuje teraz odpowiedzieć na Twoje pytanie. Copilot firmy Microsoft przygotowuje odpowiedzi dla Twojego szefa, zanim zdążysz napić się kawy. Twój telefon podsumowuje rozmowy, których nawet nie pamiętasz.

Wszystkie największe firmy technologiczne prześcigają się w wprowadzaniu sztucznej inteligencji do swoich produktów, ponieważ nikt nie chce pozostać w tyle. A społeczeństwo jest często zmuszone godzić się na takie kaprysy korporacji z powodu nasilających się skutków zjawiska „enshittification”, jak wyjaśnił Cory Doctorow w podcaście „Lock and Code”.

Ludzie korzystają ze sztucznej inteligencji. Ale jej nie ufają.

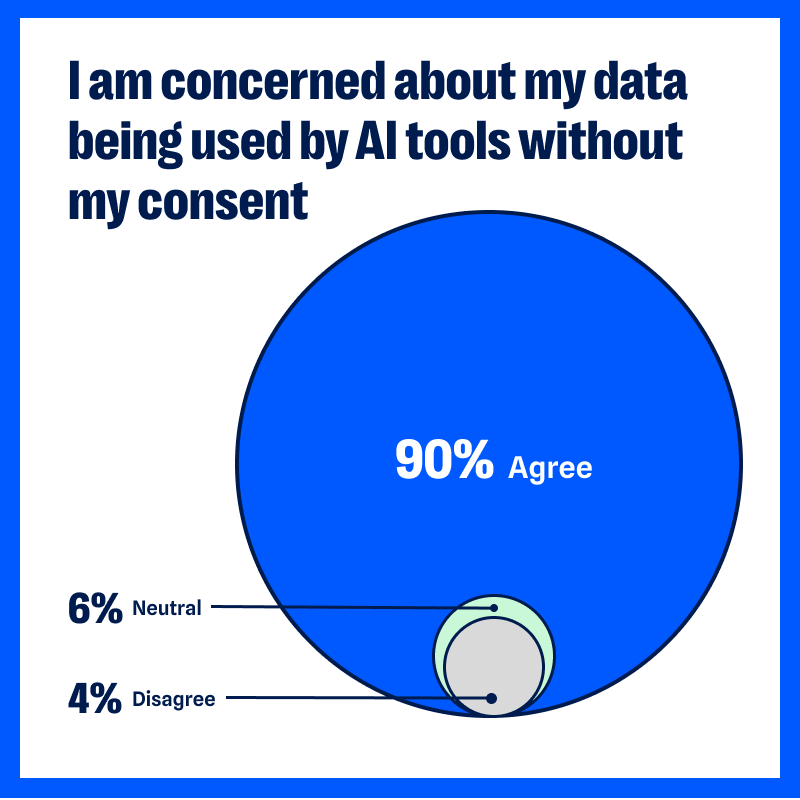

W naszej najnowszej ankiecie dotyczącej prywatności, w której na początku tego roku zebraliśmy 1200 odpowiedzi od czytelników Malwarebytes , 90% respondentów stwierdziło, że obawia się wykorzystywania ich danych przez sztuczną inteligencję bez ich zgody.

Dziewięćdziesiąt procent.

To nie jest tylko garstka sceptyków. To prawie wszyscy, których zapytaliśmy. Przyznajemy, że nasza próba jest prawdopodobnie zaniżona na korzyść osób dbających o prywatność. Jednak 90% osób śledzących Malwarebytes tym, ile danych osobowych pochłania sztuczna inteligencja i co zamierza z nimi zrobić, więc jest to dobry wskaźnik tego, jak bardzo wszyscy powinni się tym przejmować.

Ta obawa zmienia sposób, w jaki ludzie korzystają z internetu:

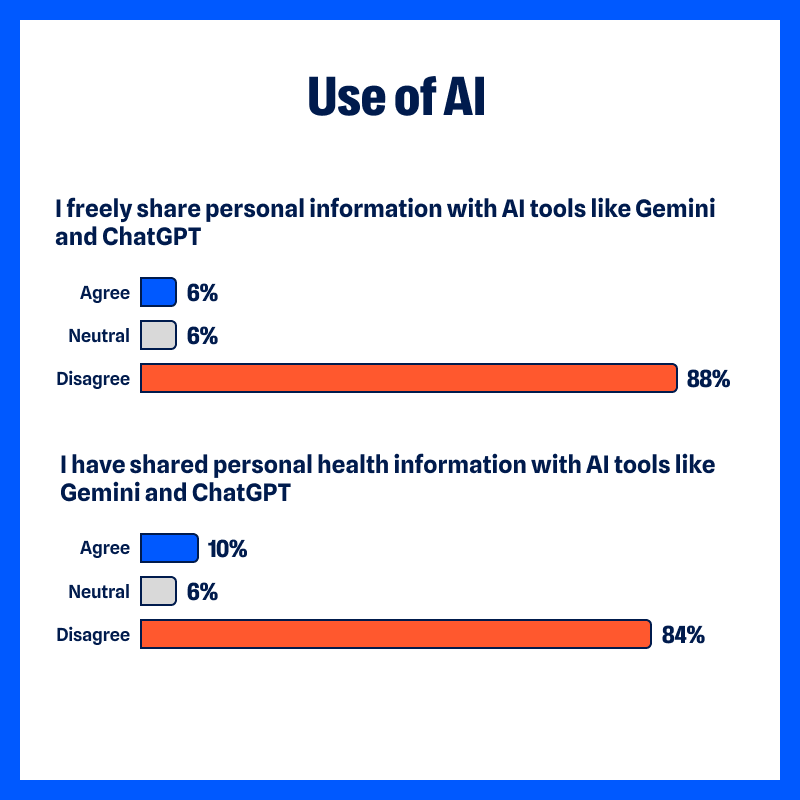

- 88% respondentów nie „udostępnia dobrowolnie swoich danych osobowych narzędziom opartym na sztucznej inteligencji, takim jak ChatGPT i Gemini”

- 84% respondentów nie „udostępniło swoich danych dotyczących zdrowia narzędziom opartym na sztucznej inteligencji”

- 43% „przestało korzystać z ChatGPT”

- 42% „przestało korzystać z Gemini”

Ta nieufność nie zaczęła się od sztucznej inteligencji

Oczywiście sztuczna inteligencja jest na pierwszych stronach gazet. Piszę o wielu z nich.

Jednak ludzie od dawna martwią się o bezpieczeństwo swoich danych osobowych.

Z ankiety:

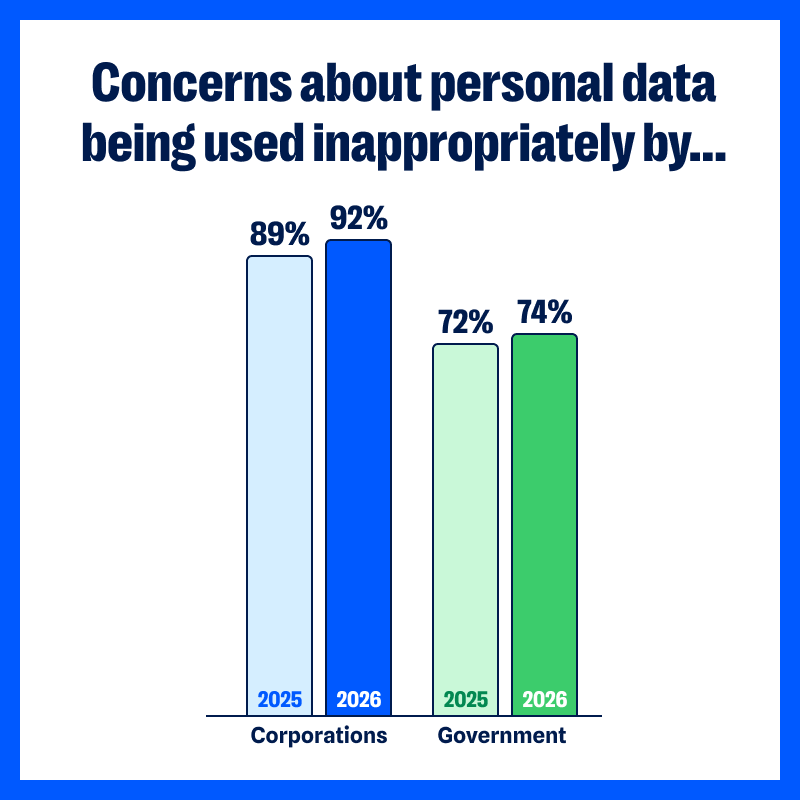

- 92% respondentów obawia się, że „przedsiębiorstwa mogą niewłaściwie wykorzystywać ich dane osobowe”, co stanowi nieznaczny wzrost w porównaniu z ubiegłym rokiem (89% w 2025 r.)

- 74% respondentów obawia się, że „rząd może uzyskać dostęp do ich danych osobowych i wykorzystywać je w niewłaściwy sposób” (wzrost z 72%)

Lata naruszeń bezpieczeństwa danych, podejrzanych praktyk śledzenia oraz niebezpiecznego nadużywania danych przez pośredników podkopały nasze zaufanie do organizacji odpowiedzialnych za ochronę naszych danych. W ciągu ostatniego roku organizacje opieki zdrowotnej nadal zgłaszały poważne uchybienia w zakresie bezpieczeństwa, które miały wpływ na wrażliwe dane pacjentów. Federalna Komisja Handlu (FTC) ostrzegła przed „oszałamiającymi” praktykami nadzoru komercyjnego, na które większość konsumentów nigdy nie wyraziła zgody, a według naszego badania 49% osób zgłosiło, że ich dane osobowe zostały wykorzystane w oszustwach wymierzonych w nich lub ich rodziny.

Czy sztuczna inteligencja naprawdę różni się od, powiedzmy, mediów społecznościowych?

Kiedy ludzie korzystają z mediów społecznościowych, zazwyczaj zdają sobie sprawę, że ich kliknięcia i polubienia są śledzone. Robiąc zakupy w Internecie, oczekują, że sklep będzie przechowywał historię ich zakupów lub śledził produkty, którymi się interesowali. Rozumieją zasadę działania reklam i dostrzegają, jak wpisują się one w serwisy społecznościowe lub komercyjne.

Narzędzia oparte na sztucznej inteligencji różnią się od siebie, ponieważ używamy ich w różny sposób.

Kiedy dzielimy się z asystentem AI pomysłami, notatkami ze spotkań z klientami, osobistymi dylematami i pytaniami dotyczącymi zdrowia, traktujemy go jak powiernika. Być może wykupiliśmy poziom dostępu, który gwarantuje, że modele nie będą trenowane na naszych danych. Nawet gdy rozmawiamy z chatbotem AI na stronie internetowej o meblach do samodzielnego montażu i brakujących śrubach, zachowujemy się tak, jakbyśmy rozmawiali z inną osobą, a nie transmitowali tę rozmowę na cały świat.

Interakcja ze sztuczną inteligencją wydaje się intymna i przypomina zwykłą rozmowę, mimo że wszyscy zdajemy sobie sprawę, że rozmawiamy z botem. To sprawia, że niepewność co do tego, w jaki sposób sztuczna inteligencja przetwarza przekazane jej dane, staje się bardziej osobista i namacalna.

Wiemy, że asystenci AI oferowani przez firmy są często zintegrowani z innymi narzędziami. Wiemy, że modele GPT może stworzyć każdy programista lub oszust. (Sprawdźcie Malwarebytes ChatGPT– należymy do tych dobrych). Wiemy, że niemal każda platforma biznesowa lub osobista zawiera obecnie jakiś element służący do gromadzenia danych w oparciu o sztuczną inteligencję. To, czego przeciętny człowiek nie wie o sztucznej inteligencji, budzi strach.

- Gdzie są przechowywane nasze podpowiedzi?

- Czy te podpowiedzi służą do szkolenia sztucznej inteligencji?

- Jak długo są przechowywane?

- Czy ktoś z pracowników firmy może je przeczytać?

- Czy można je kupić? Wykorzystać w celach reklamowych? Czy wyciekły?…

Tak, firmy publikują swoje zasady, ale kto w dzisiejszym zabieganym świecie czyta je wszystkie przed skorzystaniem z danego narzędzia? Mniej niż połowa, ale liczba ta rośnie – 48% respondentów stwierdziło, że obecnie zapoznaje się z polityką prywatności i raportami, co stanowi wzrost w porównaniu z 43% w 2025 roku.

Poza tym z ostatnich doniesień prasowych wiemy, że firmy wprowadzają na rynek funkcje oparte na sztucznej inteligencji, zanim zdążą je odpowiednio przetestować pod kątem bezpieczeństwa.

Promyk nadziei: ludzie podejmują działania

Ten wynik ankiety zwrócił naszą uwagę.

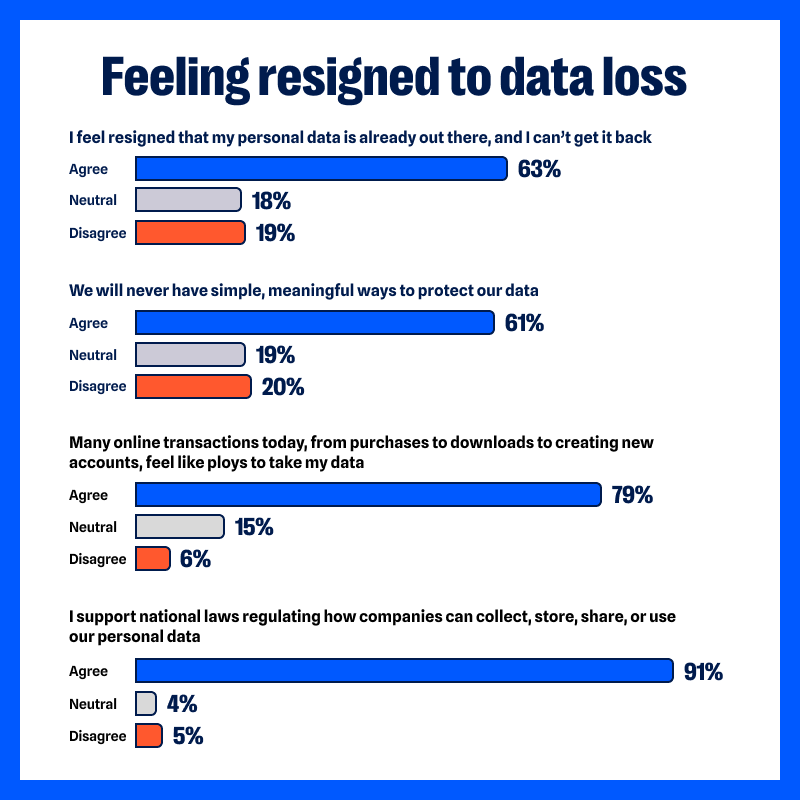

63% respondentów zgodziło się ze stwierdzeniem: „Pogodziłem się z tym, że moje dane osobowe już trafiły do sieci i nie mogę ich odzyskać”.

W zeszłym roku odsetek ten wynosił 74%.

Tak więc, choć obawy związane z nadużywaniem danych są nadal duże, mniej osób czuje się całkowicie bezradnych.

Respondenci poinformowali, że podjęli konkretne działania mające na celu ograniczenie narażenia swoich danych.

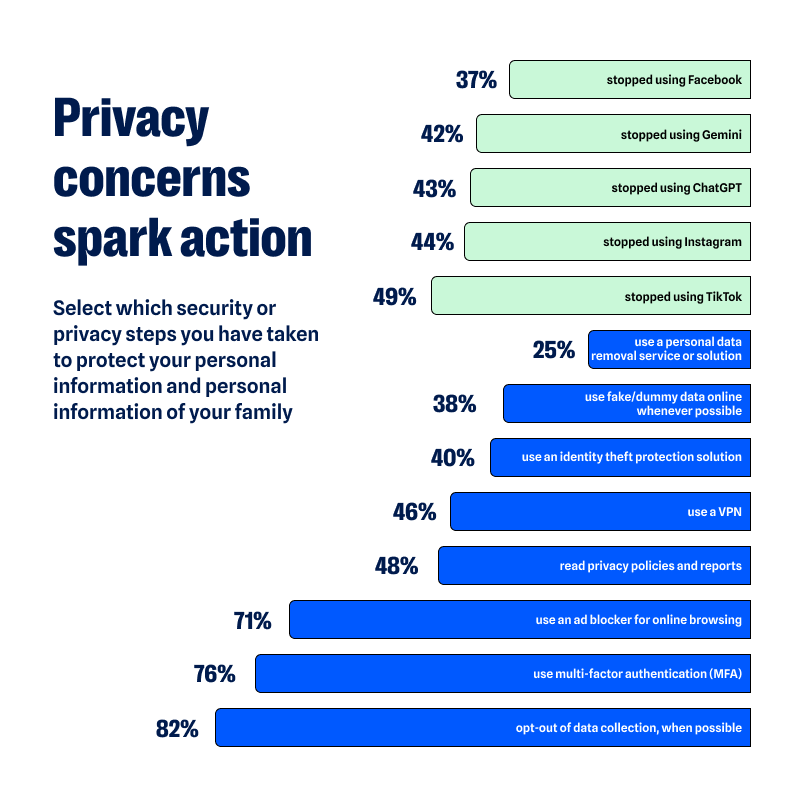

Niektórzy ograniczyli lub całkowicie zaprzestali korzystania z niektórych platform ze względu na obawy dotyczące prywatności, w tym z mediów społecznościowych (44% przestało korzystać Instagram, 37% z Facebook, a 49% z TikToka) oraz narzędzi opartych na sztucznej inteligencji (43% przestało korzystać z ChatGPT, a 42% z Gemini).

Inni przyznali, że w sieci dzielą się mniejszą ilością danych osobowych lub unikają drażliwych tematów w rozmowach online (88% respondentów stwierdziło, że nie udostępnia swobodnie danych osobowych narzędziom opartym na sztucznej inteligencji).

Coraz częściej korzystają też z narzędzi służących do ochrony prywatności swoich danych, urządzeń i tożsamości.

- 46% korzysta z sieci VPN wzrost z 42% w 2025 r.)

- 40% korzysta z rozwiązania chroniącego przed kradzieżą tożsamości (spadek z 43%)

- 25% korzysta z usług lub rozwiązań służących do usuwania danych osobowych (wzrost z 23%)

- 71% osób korzysta z programu blokującego reklamy podczas przeglądania stron internetowych (wzrost z 69%)

- 48% osób zapoznaje się z polityką prywatności i raportami (wzrost z 43%)

- 76% korzysta z uwierzytelniania wieloskładnikowego (wzrost z 69%)

- 82% użytkowników rezygnuje z gromadzenia danych, o ile to możliwe (wzrost z 75%)

- 38% respondentów korzysta w Internecie z fałszywych lub fikcyjnych danych, gdy tylko jest to możliwe (wzrost z 33%)

Żadne z tych działań nie usuwa śladów historycznych, ale ograniczają one ryzyko ponownego narażenia. David Ruiz, starszy specjalista ds. ochrony prywatności w firmie Malwarebytes, powiedział:

„Dwadzieścia lat innowacji w internecie skierowało zbyt wiele firm w tym samym kierunku – przeciwko zwykłym ludziom”.

Dla większości współczesnych ludzi korporacje, które wprowadzają narzędzia sztucznej inteligencji do ich codziennego życia, to te same firmy, które zarabiają na ich uwadze, naruszają ich prywatność i narażają ich dane na wycieki. Pojawia się jednak siła, która stanowi temu przeciwwagę.

„Te drobne zmiany w zachowaniu użytkowników powinny skłonić innych do zrozumienia, że nawet dzisiaj prywatność jest możliwa i warta zachowania”.

Privacy może wydawać się sprawą zero-jedynkową: albo wszystko jest ujawnione, albo wszystko jest bezpieczne. W rzeczywistości jednak jest to proces stopniowy, a wyniki ankiety pokazują, że ludzie zaczynają odzyskiwać kontrolę nad swoimi danymi.

Co to oznacza dla firm

Organizacje wprowadzające sztuczną inteligencję do swoich produktów mają do czynienia z bardziej zróżnicowaną grupą odbiorców, niż mogłyby początkowo przypuszczać.

Od lat zespoły produktowe zakładały, że użytkownicy chętnie udostępnią więcej danych w zamian za większą wygodę. Jednak gdy prawie dziewięć na dziesięć osób stwierdziło, że niepokoi ich wykorzystywanie ich danych przez sztuczną inteligencję bez ich zgody, zaufanie stało się integralną częścią samego produktu. Firma Mozilla szybko zareagowała na tę sytuację i dodała do przeglądarki Firefox prosty przycisk„wyłącz AI”.

Nie wystarczy już tylko podkreślać, do czego zdolna jest sztuczna inteligencja. Użytkownicy chcą wiedzieć, co dzieje się po naciśnięciu przycisku „Wyślij”.

My, obywatele… domagamy się skutecznych przepisów dotyczących ochrony prywatności

Kiedy obawy osiągają poziom, jaki odnotowaliśmy w naszej ankiecie, nieuchronnie pojawia się drażliwa kwestia regulacji.

91% respondentów stwierdziło, że „popiera przepisy krajowe regulujące sposób, w jaki firmy mogą gromadzić, przechowywać, udostępniać lub wykorzystywać nasze dane osobowe”.

Problem nie dotyczy tak bardzo samego narzędzia, ile raczej poczucia, że wytyczne są niejasne. Systemy generatywnej sztucznej inteligencji potrafią błyskawicznie sporządzać dokumenty prawne, pisać e-maile i przetwarzać dane wrażliwe. Znaczna część istniejących ram prawnych dotyczących ochrony prywatności w Stanach Zjednoczonych, Unii Europejskiej i innych regionach powstała, zanim sztuczna inteligencja stała się powszechna.

Organy regulacyjne próbują nadążyć za zmianami. Przyjęta w 2024 r. unijna ustawa o sztucznej inteligencji wprowadziła podejście oparte na ocenie ryzyka w zakresie regulacji niektórych systemów sztucznej inteligencji. W Stanach Zjednoczonych agencje federalne, w tym Federalna Komisja Handlu (FTC), opublikowały wytyczne i ostrzeżenia dotyczące nadzoru komercyjnego oraz zautomatyzowanego podejmowania decyzji, jednak w kraju tym nadal brakuje kompleksowej ustawy o ochronie prywatności poświęconej wyłącznie sztucznej inteligencji.

Zapotrzebowanie na krajowe przepisy i regulacje osiągnęło najwyższy poziom w historii. Konsumenci oczekują jasnych i egzekwowalnych ram prawnych.

Co możesz zrobić

Oczywiście nie zamierzamy całkowicie rezygnować z technologii. Sztuczna inteligencja nie zniszczy sama siebie. Może być naprawdę przydatna. Wykorzystujemy ją do wykrywania zagrożeń i oszustw, których nikt wcześniej nie zauważył, co pozwala nam zapewnić znacznie lepszą ochronę. W ramach funkcji Scam Guard stosujemy również generatywną sztuczną inteligencję, aby zapewnić całodobową pomoc na czacie (oczywiście w połączeniu z naszą dogłębną wiedzą w zakresie analizy zagrożeń). Wiele osób korzysta z niej, aby zaoszczędzić czas, tworzyć szkice dokumentów lub rozwijać pomysły. Niestety, niektórzy używają jej również do tworzenia małych karykatur samych siebie.

Najważniejsze jest tutaj przemyślane wykorzystanie.

- Ograniczaj zakres informacji, które udostępniasz publicznym narzędziom opartym na sztucznej inteligencji, zwłaszcza danych dotyczących zdrowia, danych finansowych oraz informacji wrażliwych dotyczących klientów.

- Zapoznaj się z polityką prywatności i zasadami przechowywania danych narzędzi opartych na sztucznej inteligencji, z których regularnie korzystasz.

- Usuń konta i aplikacje, których już nie potrzebujesz.

- Co najmniej dwa razy w roku należy sprawdzać uprawnienia aplikacji.

- Skorzystaj z sieci VPN ograniczyć śledzenie przez dostawcę usług internetowych.

- Usuń swoje dane z głównych serwisów zajmujących się handlem danymi. Sprawdź, czy Twoje dane osobowe są narażone na wyciek, korzystając ze skanera śladu cyfrowego.

- Korzystaj z renomowanego menedżera haseł i unikaj używania tych samych haseł w różnych serwisach.

W Malwarebytes wierzymy, że prywatność jest prawem człowieka. Ochrona danych osobowych jest nierozerwalnie związana z ochroną bezpieczeństwa osobistego. Im więcej informacji krąży bez nadzoru, tym większe jest ryzyko nadużyć, oszustw i szkód.

Sztuczna inteligencja będzie się nadal rozwijać. Jest mało prawdopodobne, by tempo tego rozwoju uległo spowolnieniu. Pytanie brzmi, czy wraz z nim wzrośnie zaufanie.

Informacje dotyczące ankiety

W dniach od 26 stycznia do 3 lutego 2026 r. Malwarebytes ankietę wśród czytelników swojego newslettera za pośrednictwem platformy Alchemer Survey.

W sumie w ankiecie wzięło udział 1 235 osób z 72 krajów, przy czym większość respondentów pochodziła ze Stanów Zjednoczonych, Wielkiej Brytanii, Kanady i Australii.