L'intelligenza artificiale non si è intrufolata nelle nostre vite. Ha fatto irruzione, si è seduta al tavolo e ha iniziato a finire le nostre frasi.

Invece di un utile elenco di link, Google ora cerca di rispondere alla tua domanda. Copilot di Microsoft redige le risposte per il tuo capo prima ancora che tu abbia bevuto il caffè. Il tuo telefono riassume conversazioni che non ricordi nemmeno di aver avuto.

Tutte le principali aziende tecnologiche stanno facendo a gara per integrare l'intelligenza artificiale nei propri prodotti, perché nessuno vuole restare indietro. E il pubblico è spesso costretto ad adeguarsi a questi capricci aziendali a causa dei crescenti effetti dell'«enshittification», come spiegato da Cory Doctorow nel podcast Lock and Code.

La gente usa l'intelligenza artificiale. Ma non si fida.

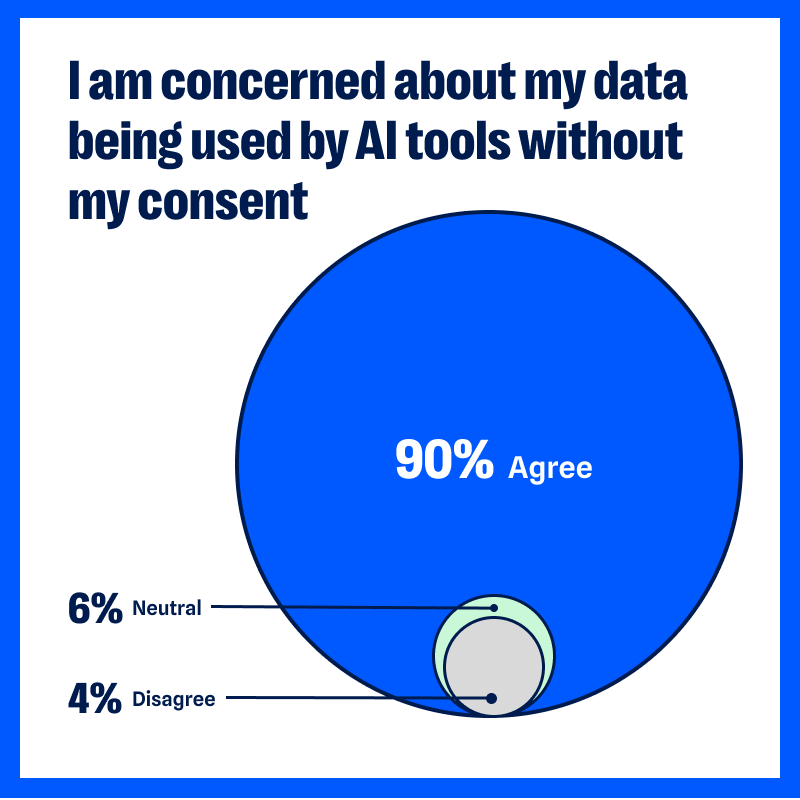

Nel nostro ultimo sondaggio sulla privacy, condotto all’inizio di quest’anno tra i lettori della Malwarebytes e che ha raccolto 1.200 risposte, il 90% degli intervistati ha dichiarato di essere preoccupato che l’intelligenza artificiale possa utilizzare i propri dati senza il proprio consenso.

Il novanta per cento.

Non si tratta di pochi scettici. Si tratta praticamente di tutti quelli a cui abbiamo chiesto. Lo ammettiamo, il nostro campione è probabilmente sbilanciato a favore di chi è particolarmente attento alla privacy. Ma il 90% delle persone che seguono Malwarebytes preoccupato per la quantità di dati personali che l'intelligenza artificiale sta raccogliendo e per l'uso che ne farà, quindi questo è un buon indicatore di quanto tutti dovrebbero preoccuparsene.

Questa preoccupazione sta cambiando il modo in cui le persone utilizzano Internet:

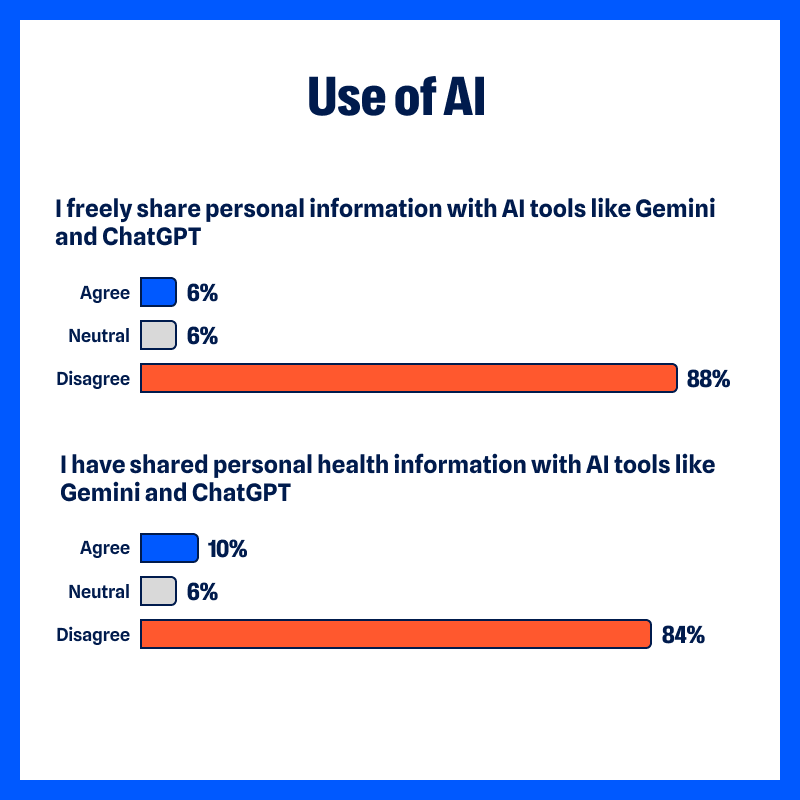

- L'88% non «condivide liberamente le proprie informazioni personali con strumenti di IA come ChatGPT e Gemini»

- L'84% non ha «condiviso informazioni sanitarie personali con strumenti di intelligenza artificiale»

- Il 43% ha «smesso di usare ChatGPT»

- Il 42% ha «smesso di usare Gemini»

Questa sfiducia non è nata con l'intelligenza artificiale

Ovviamente, l'intelligenza artificiale fa sempre notizia. Noi ne parliamo spesso.

Ma è da molto tempo che le persone nutrono preoccupazioni riguardo alla conservazione dei propri dati personali.

Dall'indagine:

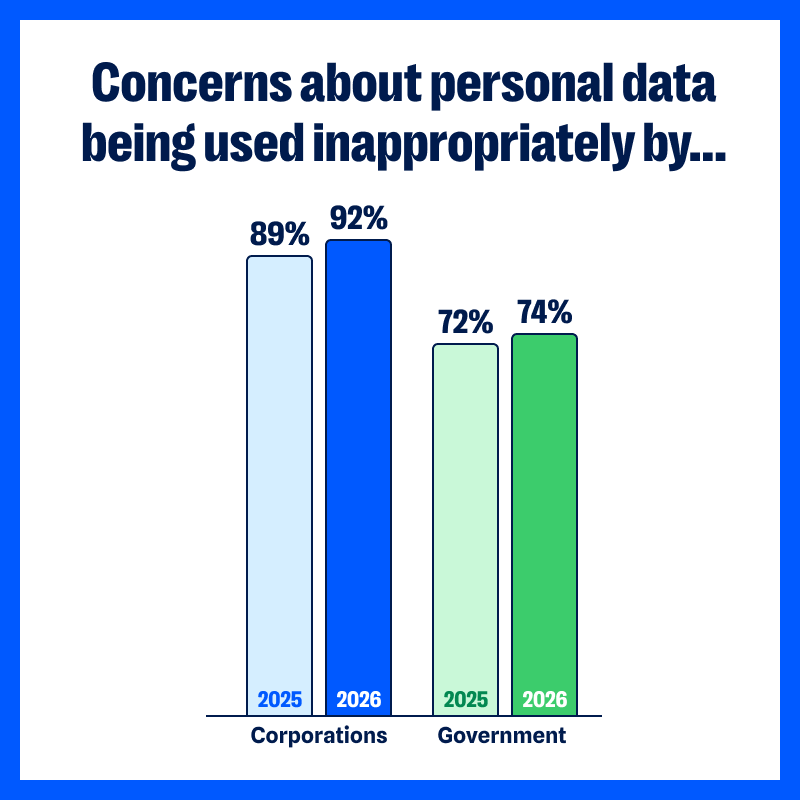

- Il 92% è preoccupato che i propri «dati personali vengano utilizzati in modo improprio dalle aziende», una percentuale in leggero aumento rispetto allo scorso anno (89% nel 2025)

- Il 74% teme che «i propri dati personali possano essere consultati e utilizzati in modo improprio dal governo» (in aumento rispetto al 72%)

Anni di violazioni dei dati, pratiche di tracciamento discutibili e pericolosi abusi da parte dei broker di dati hanno minato la nostra fiducia nella capacità delle organizzazioni di proteggere i nostri dati. Nell'ultimo anno, le organizzazioni sanitarie hanno continuato a segnalare gravi falle nella sicurezza che hanno interessato i dati sensibili dei pazienti. La FTC ha messo in guardia da pratiche di sorveglianza commerciale "sbalorditive" che la maggior parte dei consumatori non ha mai accettato e, secondo il nostro sondaggio, il 49% delle persone ha riferito che le proprie informazioni personali sono state utilizzate in truffe che prendono di mira loro o la loro famiglia.

L'intelligenza artificiale è davvero così diversa, ad esempio, dai social media?

Quando le persone utilizzano i social media, in genere sono consapevoli che i loro clic e i loro "Mi piace" vengono monitorati. Quando fanno acquisti online, si aspettano che il negozio conservi la cronologia dei loro acquisti o tenga traccia degli articoli a cui hanno mostrato interesse. Comprendono il concetto di pubblicità e ne riconoscono il ruolo nei siti web sociali o commerciali.

Gli strumenti di intelligenza artificiale sono diversi perché li usiamo in modo diverso.

Quando condividiamo idee, appunti sulle riunioni con i clienti, dilemmi personali e domande sulla salute con un assistente IA, lo trattiamo come un confidente. Forse abbiamo acquistato un livello di accesso che garantisce che i modelli non vengano addestrati sui nostri dati. Anche quando chiacchieriamo di mobili in kit e viti mancanti con il chatbot IA di un sito, ci comportiamo come se stessimo parlando con un'altra persona, e non come se stessimo trasmettendo quella conversazione al mondo intero.

L'interazione con l'IA risulta intima e colloquiale, anche se sappiamo tutti che stiamo parlando con un bot. Questo rende l'incertezza su come l'IA gestisca i dati che le abbiamo fornito più personale, più immediata.

Sappiamo che gli assistenti basati sull'intelligenza artificiale (IA) di un'azienda sono spesso integrati con altri strumenti. Sappiamo che i modelli GPT possono essere creati da qualsiasi sviluppatore o truffatore. (Cercate " Malwarebytes " Malwarebytes ChatGPT: noi siamo tra quelli "buoni"). Sappiamo che quasi tutte le piattaforme aziendali o personali dispongono ormai di qualche forma di sistema di raccolta dati basato sull'IA. Ciò che la persona media non sa riguardo all'IA può incutere timore.

- Dove vengono salvati i nostri suggerimenti?

- Quei prompt vengono utilizzati per addestrare l'IA?

- Per quanto tempo vengono conservati?

- Qualcuno all'interno dell'azienda può leggerli?

- Si possono acquistare? Si possono usare a fini pubblicitari? Sono trapelate?…

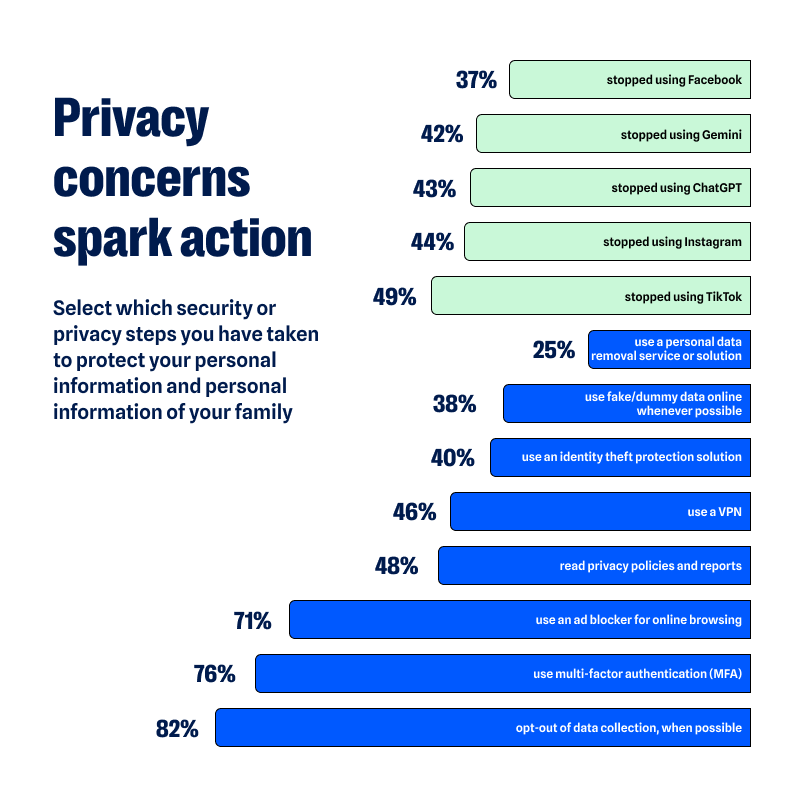

Sì, le aziende pubblicano le loro informative, ma chi, nella realtà di tutti i giorni, le legge tutte prima di utilizzare lo strumento? Meno della metà, ma si tratta di una percentuale in crescita: il 48% dichiara infatti di leggere ora le informative sulla privacy e i rapporti, rispetto al 43% del 2025.

Inoltre, come si evince dalle notizie degli ultimi giorni, le aziende stanno lanciando in fretta e furia funzionalità basate sull'intelligenza artificiale prima ancora di aver avuto il tempo di sottoporle a adeguati controlli di sicurezza.

Un barlume di speranza: la gente si sta dando da fare

Questo risultato del sondaggio ha attirato la nostra attenzione.

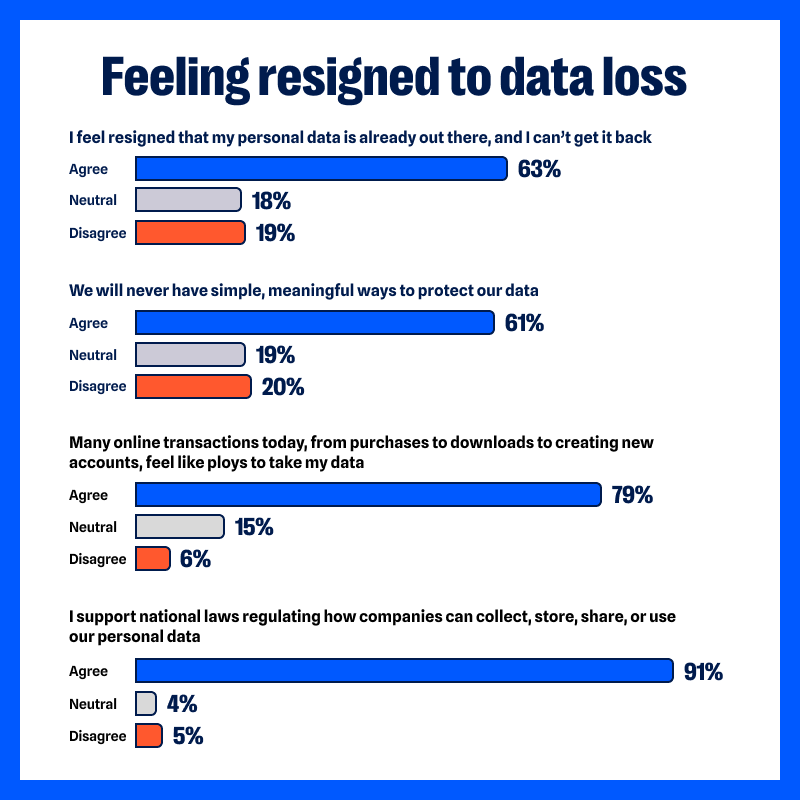

Il 63% degli intervistati si è detto d'accordo con l'affermazione: «Mi sono rassegnato al fatto che i miei dati personali siano già in circolazione e che non possa recuperarli».

L'anno scorso, quella percentuale era del 74%.

Pertanto, sebbene la preoccupazione per l'uso improprio dei dati rimanga elevata, sono meno le persone che si sentono completamente impotenti.

Gli intervistati hanno riferito di aver adottato misure concrete per limitare la divulgazione dei propri dati.

Alcuni hanno ridotto o interrotto del tutto l'uso di determinate piattaforme a causa di preoccupazioni relative alla privacy, tra cui i social media (il 44% ha smesso di usare Instagram, il 37% ha smesso di usare Facebook e il 49% ha smesso di usare TikTok) e gli strumenti di intelligenza artificiale (il 43% ha smesso di usare ChatGPT, il 42% ha smesso di usare Gemini).

Altri hanno riferito di condividere meno informazioni personali online o di evitare argomenti delicati nelle conversazioni digitali (l'88% ha dichiarato di non condividere liberamente informazioni personali con gli strumenti di IA).

Si registra inoltre un crescente ricorso a strumenti di protezione della privacy per i propri dati, dispositivi e identità.

- Il 46% utilizza una VPN in aumento rispetto al 42% del 2025)

- Il 40% dispone di una soluzione per la protezione dal furto d'identità (in calo rispetto al 43%)

- Il 25% ricorre a un servizio o a una soluzione per la cancellazione dei dati personali (in aumento rispetto al 23%)

- Il 71% utilizza un ad blocker per navigare in rete (in aumento rispetto al 69%)

- Il 48% legge le informative sulla privacy e i rapporti (in aumento rispetto al 43%)

- Il 76% utilizza l'autenticazione a più fattori (in aumento rispetto al 69%)

- L'82% sceglie di non acconsentire alla raccolta dei dati, ove possibile (in aumento rispetto al 75%)

- Il 38% utilizza dati fittizi o di prova online ogni volta che è possibile (in aumento rispetto al 33%)

Nessuna di queste misure cancella le tracce dei dati storici, ma limita l'esposizione futura. David Ruiz, responsabile della tutela della privacy presso Malwarebytes, ha dichiarato:

«Vent’anni di innovazione online hanno spinto troppe aziende nella stessa direzione: contro la gente comune.

Per la maggior parte delle persone oggi, le aziende che stanno introducendo con forza gli strumenti di intelligenza artificiale nella loro vita quotidiana sono le stesse che hanno monetizzato la loro capacità di attenzione, violato la loro privacy e causato la perdita dei loro dati a causa di violazioni. Ma sta emergendo una forza contraria.

«Questi piccoli cambiamenti nel comportamento degli utenti dovrebbero incoraggiare gli altri a capire che, anche oggi, la privacy è ancora possibile e vale la pena di essere difesa.»

Privacy può sembrare una questione binaria: o tutto è esposto o tutto è al sicuro. Ma si tratta di un processo graduale, e le risposte al sondaggio riflettono il modo in cui le persone stanno iniziando a riprendere il controllo dei propri dati.

Cosa significa questo per le aziende

Le aziende che integrano l'intelligenza artificiale nei propri prodotti si trovano ad affrontare un pubblico più complesso di quanto potessero inizialmente immaginare.

Per anni, i team di sviluppo hanno dato per scontato che gli utenti fossero disposti a concedere più dati in cambio di una maggiore comodità. Ma quando quasi nove persone su dieci hanno dichiarato di essere preoccupate dal fatto che l’intelligenza artificiale possa utilizzare i loro dati senza il loro consenso, la fiducia è diventata parte integrante del prodotto stesso. Mozilla ha colto al volo questa opportunità e ha aggiunto a Firefox un semplice pulsanteper «disattivare l’IA».

Non basta più limitarsi a mettere in evidenza ciò che l'intelligenza artificiale è in grado di fare. Gli utenti vogliono capire cosa succede dopo aver cliccato su «Invia».

Noi, il popolo… vogliamo leggi rigorose sulla privacy

Quando la preoccupazione raggiunge i livelli che abbiamo riscontrato nel nostro sondaggio, inevitabilmente si pone la spinosa questione della regolamentazione.

Il 91% degli intervistati ha dichiarato di «sostenere le leggi nazionali che regolano le modalità con cui le aziende possono raccogliere, conservare, condividere o utilizzare i nostri dati personali».

Il problema non riguarda tanto uno strumento specifico, quanto piuttosto la sensazione che i limiti non siano chiari. I sistemi di IA generativa sono in grado di redigere documenti legali, scrivere e-mail ed elaborare dati sensibili a grande velocità. Gran parte dei quadri normativi esistenti in materia di privacy negli Stati Uniti, nell’Unione Europea e in altre regioni sono stati elaborati prima che l’IA diventasse di uso comune.

Le autorità di regolamentazione stanno cercando di recuperare il ritardo. La legge sull'IA dell'Unione Europea, approvata nel 2024, ha introdotto un approccio basato sul rischio per la regolamentazione di determinati sistemi di IA. Negli Stati Uniti, le agenzie federali, tra cui la FTC, hanno pubblicato linee guida e avvertimenti in materia di sorveglianza commerciale e processi decisionali automatizzati, ma non esiste ancora una normativa completa sulla privacy specifica per l'IA.

La richiesta di leggi e normative nazionali non è mai stata così forte. I consumatori vogliono regole chiare e applicabili.

Cosa puoi fare

È chiaro che non abbandoneremo del tutto la tecnologia. L’IA non finirà per autodistruggersi. Può essere davvero utile. Utilizziamo l’IA per individuare minacce e truffe mai viste prima, garantendo così una protezione di gran lunga superiore. Inoltre, in Scam Guard impieghiamo l’IA generativa per fornire assistenza tramite chat 24 ore su 24, 7 giorni su 7 (abbinata, ovviamente, alla nostra profonda competenza nella ricerca sulle minacce). Molte persone la utilizzano per risparmiare tempo, redigere bozze di documenti o sviluppare idee. E, purtroppo, anche per creare piccole caricature di se stessi.

La chiave sta nell'uso oculato.

- Limitate le informazioni che fornite agli strumenti di IA di dominio pubblico, in particolare i dati sanitari, quelli finanziari e le informazioni riservate sui clienti.

- Controlla le politiche sulla privacy e sulla conservazione dei dati degli strumenti di intelligenza artificiale che utilizzi regolarmente.

- Elimina gli account e le app che non ti servono più.

- Controlla le autorizzazioni delle app almeno due volte all'anno.

- Utilizza una VPN limitare il tracciamento da parte del tuo provider di servizi Internet.

- Rimuovi i tuoi dati dai principali siti di brokeraggio di dati. Verifica se le tue informazioni personali sono state divulgate tramite una scansione della tua impronta digitale.

- Utilizza un gestore di password affidabile ed evita di riutilizzare le stesse password su diversi servizi.

Noi di Malwarebytes crediamo che la privacy sia un diritto umano. La tutela dei dati personali è indissolubilmente legata alla tutela della sicurezza personale. Più informazioni circolano senza alcun controllo, maggiori sono le possibilità di abusi, frodi e danni.

L'intelligenza artificiale continuerà a svilupparsi. È improbabile che questo trend subisca un rallentamento. La domanda è: la fiducia crescerà di pari passo?

Informazioni sul sondaggio

Malwarebytes un sondaggio lampo tra i lettori della propria newsletter tra il 26 gennaio e il 3 febbraio 2026, tramite la piattaforma Alchemer Survey.

In totale hanno risposto 1.235 persone provenienti da 72 paesi, la maggior parte delle quali dagli Stati Uniti, dal Regno Unito, dal Canada e dall'Australia.